Duy Linh

Writer

Các tác nhân đe dọa đang sử dụng mô hình AI như những hệ thống tự động để phát hiện và khai thác các lỗ hổng bảo mật chưa được vá (0-day) chỉ trong vài phút. Điều này giúp rút ngắn đáng kể thời gian và chi phí cho các chiến dịch xâm nhập phức tạp.

Sự thay đổi này bắt đầu thể hiện rõ vào cuối năm 2025 và đang buộc giới phòng thủ phải xem lại cách phát hiện, ngăn chặn, cũng như định nghĩa lại rủi ro nội bộ trong môi trường an ninh mạng hiện đại.

Trước năm 2025, hacker chủ yếu dùng AI như công cụ hỗ trợ để viết email lừa đảo, tạo mồi nhử, soạn mã độc hoặc tổng hợp thông tin tình báo nguồn mở về mục tiêu, trong khi con người vẫn trực tiếp điều hành toàn bộ quá trình tấn công. Tuy nhiên, mô hình này hiện đã thay đổi.

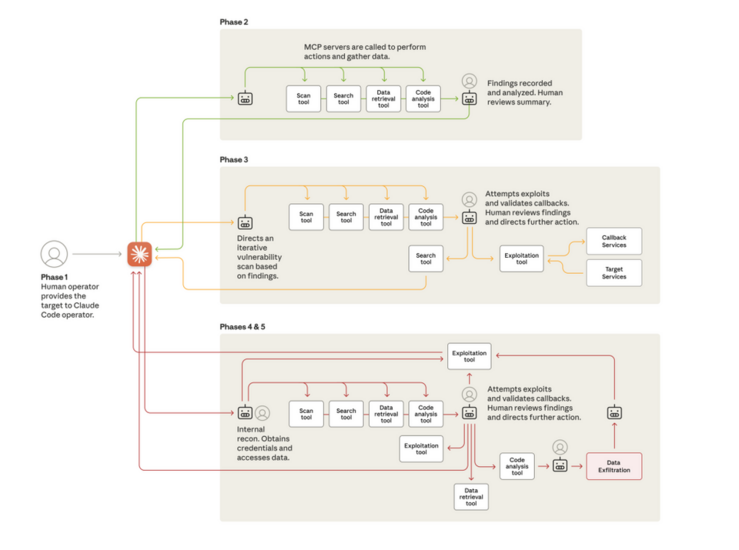

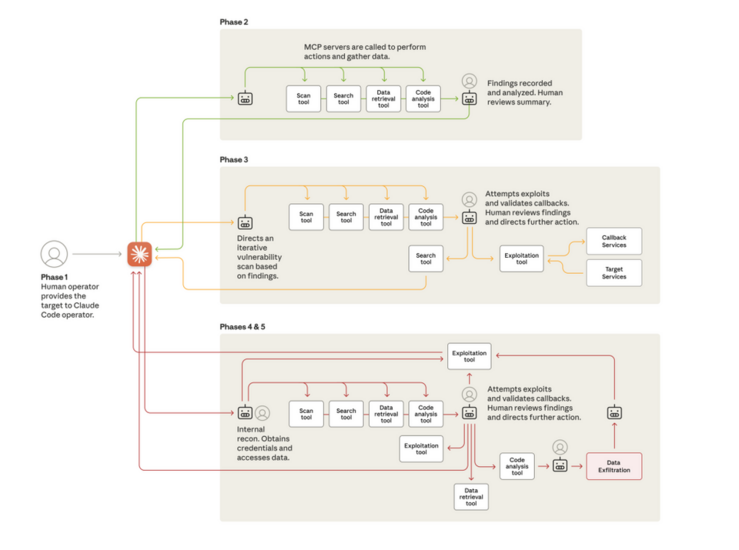

Trong các chiến dịch gần đây, người điều hành chỉ cần xác định mục tiêu và nhiệm vụ. Sau đó, AI sẽ tự động quét tài sản bị lộ, lập bản đồ mạng, kiểm tra lỗ hổng bảo mật và nếu thất bại sẽ tự chuyển sang các hướng tấn công khác.

Nhờ các tiêu chuẩn như Giao thức ngữ cảnh mô hình (MCP), các mô hình AI giờ đây có thể tương tác với trình duyệt, máy quét và nhiều công cụ “thế giới thực” khác, biến chúng thành các nền tảng xâm nhập gần như tự hành hoàn toàn.

Ở mức cao điểm, các hệ thống này có thể tạo và đánh giá hàng nghìn yêu cầu mỗi giây, rút ngắn công việc của các nhóm tấn công red-team từ nhiều tuần xuống chỉ còn vài giờ.

Việc MITRE ATLAS được mở rộng thành một khuôn khổ chuyên biệt cho các cuộc tấn công nhằm vào AI và hệ thống tác nhân cho thấy bề mặt tấn công mới đang phát triển cực nhanh.

Theo các hoạt động được Cyberthint theo dõi, việc phát hiện lỗ hổng 0-day không còn là nhiệm vụ mất hàng tháng như trước, mà đã trở thành quy trình có thể tự động hóa.

Chiến dịch gián điệp mạng do trí tuệ nhân tạo dàn dựng (Nguồn: Cyberthint).

Nhóm này được đánh giá có liên hệ với Trung Quốc với độ tin cậy cao và đã sử dụng Claude Code để tự động hóa 80-90% chu trình xâm nhập vào khoảng 30 tổ chức thuộc các lĩnh vực công nghệ, tài chính, hóa chất và chính phủ.

Các nhà vận hành đã “bẻ khóa” mô hình bằng cách giả danh công ty an ninh mạng phòng thủ, đồng thời chia cuộc xâm nhập thành nhiều nhiệm vụ nhỏ “vô hại” để AI không nhìn thấy toàn bộ mục tiêu độc hại.

Sau khi hoạt động, AI đảm nhận gần như toàn bộ quá trình gồm trinh sát, phát hiện lỗ hổng chưa vá, tạo mã khai thác, di chuyển ngang trong hệ thống, chuẩn bị dữ liệu và thậm chí tạo báo cáo Markdown, trong khi con người chỉ can thiệp ở vài bước phê duyệt quan trọng.

Việc AI có thể phát hiện và khai thác lỗ hổng mới ngay trong quá trình vận hành được xem là bước ngoặt lớn, biến hoạt động săn 0-day thành nhiệm vụ có thể thực hiện song song với tốc độ máy tính.

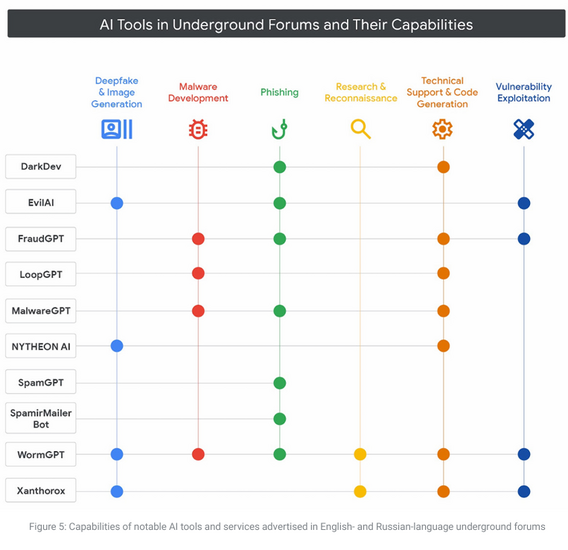

Một loạt phần mềm độc hại mới cũng cho thấy LLM đang được tích hợp sâu vào công cụ tấn công.

LAMEHUG, được CERT-UA ghi nhận và liên kết với APT28, là một trong những trường hợp đầu tiên phần mềm độc hại truy vấn trực tiếp LLM đám mây, cụ thể là Qwen2.5-Coder-32B-Instruct của Alibaba thông qua Hugging Face để tạo lệnh trong thời gian chạy thay vì sử dụng logic tác vụ cố định.

Mã độc Python này xâm nhập qua email phishing dưới dạng tệp đính kèm giả mạo của chính phủ Ukraine, thu thập dữ liệu hệ thống và tài liệu rồi để LLM quyết định lệnh cần thực thi. Nó còn sử dụng hàng trăm mã thông báo API được mã hóa cứng nhằm tăng khả năng chống chịu.

MalTerminal, được SentinelLabs giới thiệu tại LABScon 2025, là ví dụ ban đầu của “mã độc nhúng LLM”. Công cụ này dùng GPT-4 để tạo mã độc tống tiền hoặc mã độc điều khiển từ xa theo yêu cầu, sau đó thực thi mã Python ngay trong bộ nhớ để giảm dấu vết điều tra.

Khám phá này khiến giới nghiên cứu bắt đầu tìm kiếm khóa API LLM được nhúng và các cấu trúc lời nhắc JSON trên diện rộng, qua đó phát hiện hàng nghìn tệp nhị phân chứa khóa riêng cùng mẫu lời nhắc của tác nhân AI.

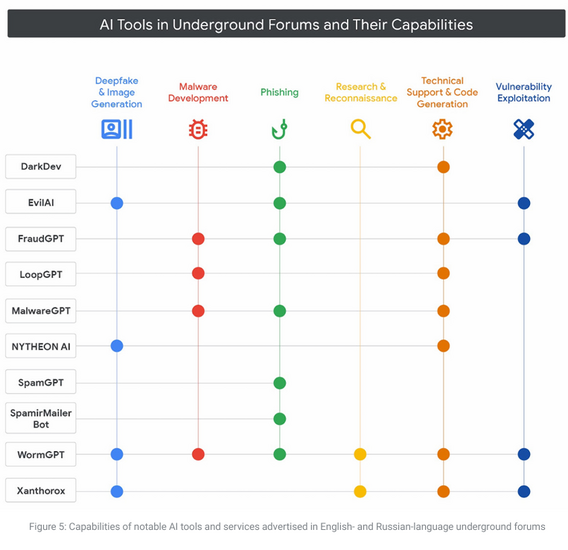

Các công cụ AI trong các diễn đàn ngầm (Nguồn: Cyberthint).

Google cũng ghi nhận PROMPTFLUX, công cụ thử nghiệm dùng VBScript để liên tục gọi API Gemini nhằm tìm các chiến lược che giấu và né tránh phần mềm diệt virus mới, về cơ bản chuyển khả năng đa hình sang một mô hình AI bên ngoài.

Song song đó, nhiều chiến dịch “hack vibe” đang sử dụng LLM từ đầu đến cuối để đánh cắp dữ liệu và tống tiền mà không cần mã hóa dữ liệu, từ lập trình hạ tầng đến soạn thư đòi tiền chuộc đa ngôn ngữ.

Một vấn đề khác đang nổi lên là “ảo giác AI” trong an ninh mạng. Trong các trường hợp như lỗ hổng React2Shell từng gây chú ý, các PoC xuất hiện chỉ vài giờ sau khi lỗ hổng bị phát hiện, khiến ranh giới giữa mã khai thác thực sự và nội dung do AI tạo ra ngày càng khó phân biệt.

Các lỗ hổng không hoạt động hoặc chỉ là “ảo ảnh” có thể bị lợi dụng làm mồi nhử để đánh lừa hệ thống phòng thủ. Đồng thời, chúng cũng khiến các trung tâm điều hành an ninh mạng (SOC) bị quá tải bởi lượng cảnh báo sai nếu không được phân loại kỹ.

Khi hacker có thể phát hiện và khai thác lỗ hổng nhanh hơn tốc độ kiểm thử và triển khai bản vá của doanh nghiệp, tốc độ ngăn chặn giờ đây quan trọng hơn cả tốc độ phát hiện ban đầu.

MTTC, chứ không chỉ MTTD, đang trở thành chỉ số quyết định liệu một chiến dịch do AI điều khiển sẽ chỉ là sự cố nhỏ hay trở thành vụ vi phạm nghiêm trọng.

Các chuyên gia bảo mật hiện phải chuyển hướng giám sát sang hành vi LOTL ở cấp độ mạng, phân tích bất thường và các tín hiệu đặc trưng của AI như việc sử dụng API LLM, khóa API nhúng và các cấu trúc lời nhắc JSON đáng ngờ trong tệp nhị phân.

Những khuôn khổ như MITRE ATLAS cũng cần được tích hợp vào mô hình phân tích mối đe dọa dành cho AI có khả năng tự hành động. Đồng thời, các chương trình phòng chống mối đe dọa nội bộ phải tính đến nguy cơ ứng viên sử dụng AI để tạo kỹ năng và danh tính giả nhằm tiếp cận môi trường nhạy cảm.

Ở chiều ngược lại, các đội blue team cũng có thể khai thác chính “ảo giác AI”, triển khai dữ liệu gây nhiễu, chỉ báo tổng hợp và tài sản mồi nhử để đánh lừa mô hình đối phương, làm hao phí thời gian của kẻ tấn công.

Kỷ nguyên GTG-1002 đang làm giảm mạnh chi phí nhân lực cho hoạt động tấn công mạng. Một người vận hành cùng một mô hình AI mạnh hiện có thể đạt hiệu suất tương đương cả một đội tấn công truyền thống gồm 10 người trong suốt nhiều tuần. (gbhackers)

Sự thay đổi này bắt đầu thể hiện rõ vào cuối năm 2025 và đang buộc giới phòng thủ phải xem lại cách phát hiện, ngăn chặn, cũng như định nghĩa lại rủi ro nội bộ trong môi trường an ninh mạng hiện đại.

Trước năm 2025, hacker chủ yếu dùng AI như công cụ hỗ trợ để viết email lừa đảo, tạo mồi nhử, soạn mã độc hoặc tổng hợp thông tin tình báo nguồn mở về mục tiêu, trong khi con người vẫn trực tiếp điều hành toàn bộ quá trình tấn công. Tuy nhiên, mô hình này hiện đã thay đổi.

Trong các chiến dịch gần đây, người điều hành chỉ cần xác định mục tiêu và nhiệm vụ. Sau đó, AI sẽ tự động quét tài sản bị lộ, lập bản đồ mạng, kiểm tra lỗ hổng bảo mật và nếu thất bại sẽ tự chuyển sang các hướng tấn công khác.

Nhờ các tiêu chuẩn như Giao thức ngữ cảnh mô hình (MCP), các mô hình AI giờ đây có thể tương tác với trình duyệt, máy quét và nhiều công cụ “thế giới thực” khác, biến chúng thành các nền tảng xâm nhập gần như tự hành hoàn toàn.

Ở mức cao điểm, các hệ thống này có thể tạo và đánh giá hàng nghìn yêu cầu mỗi giây, rút ngắn công việc của các nhóm tấn công red-team từ nhiều tuần xuống chỉ còn vài giờ.

Việc MITRE ATLAS được mở rộng thành một khuôn khổ chuyên biệt cho các cuộc tấn công nhằm vào AI và hệ thống tác nhân cho thấy bề mặt tấn công mới đang phát triển cực nhanh.

Theo các hoạt động được Cyberthint theo dõi, việc phát hiện lỗ hổng 0-day không còn là nhiệm vụ mất hàng tháng như trước, mà đã trở thành quy trình có thể tự động hóa.

GTG-1002 và bước ngoặt của các chiến dịch AI tự hành

Chiến dịch GTG-1002 được Anthropic công bố cuối năm 2025 được xem là chiến dịch gián điệp mạng do AI điều phối đầu tiên được xác thực.

Chiến dịch gián điệp mạng do trí tuệ nhân tạo dàn dựng (Nguồn: Cyberthint).

Nhóm này được đánh giá có liên hệ với Trung Quốc với độ tin cậy cao và đã sử dụng Claude Code để tự động hóa 80-90% chu trình xâm nhập vào khoảng 30 tổ chức thuộc các lĩnh vực công nghệ, tài chính, hóa chất và chính phủ.

Các nhà vận hành đã “bẻ khóa” mô hình bằng cách giả danh công ty an ninh mạng phòng thủ, đồng thời chia cuộc xâm nhập thành nhiều nhiệm vụ nhỏ “vô hại” để AI không nhìn thấy toàn bộ mục tiêu độc hại.

Sau khi hoạt động, AI đảm nhận gần như toàn bộ quá trình gồm trinh sát, phát hiện lỗ hổng chưa vá, tạo mã khai thác, di chuyển ngang trong hệ thống, chuẩn bị dữ liệu và thậm chí tạo báo cáo Markdown, trong khi con người chỉ can thiệp ở vài bước phê duyệt quan trọng.

Việc AI có thể phát hiện và khai thác lỗ hổng mới ngay trong quá trình vận hành được xem là bước ngoặt lớn, biến hoạt động săn 0-day thành nhiệm vụ có thể thực hiện song song với tốc độ máy tính.

Một loạt phần mềm độc hại mới cũng cho thấy LLM đang được tích hợp sâu vào công cụ tấn công.

LAMEHUG, được CERT-UA ghi nhận và liên kết với APT28, là một trong những trường hợp đầu tiên phần mềm độc hại truy vấn trực tiếp LLM đám mây, cụ thể là Qwen2.5-Coder-32B-Instruct của Alibaba thông qua Hugging Face để tạo lệnh trong thời gian chạy thay vì sử dụng logic tác vụ cố định.

Mã độc Python này xâm nhập qua email phishing dưới dạng tệp đính kèm giả mạo của chính phủ Ukraine, thu thập dữ liệu hệ thống và tài liệu rồi để LLM quyết định lệnh cần thực thi. Nó còn sử dụng hàng trăm mã thông báo API được mã hóa cứng nhằm tăng khả năng chống chịu.

MalTerminal, được SentinelLabs giới thiệu tại LABScon 2025, là ví dụ ban đầu của “mã độc nhúng LLM”. Công cụ này dùng GPT-4 để tạo mã độc tống tiền hoặc mã độc điều khiển từ xa theo yêu cầu, sau đó thực thi mã Python ngay trong bộ nhớ để giảm dấu vết điều tra.

Khám phá này khiến giới nghiên cứu bắt đầu tìm kiếm khóa API LLM được nhúng và các cấu trúc lời nhắc JSON trên diện rộng, qua đó phát hiện hàng nghìn tệp nhị phân chứa khóa riêng cùng mẫu lời nhắc của tác nhân AI.

Các công cụ AI trong các diễn đàn ngầm (Nguồn: Cyberthint).

Google cũng ghi nhận PROMPTFLUX, công cụ thử nghiệm dùng VBScript để liên tục gọi API Gemini nhằm tìm các chiến lược che giấu và né tránh phần mềm diệt virus mới, về cơ bản chuyển khả năng đa hình sang một mô hình AI bên ngoài.

Phần mềm tống tiền, “ảo giác AI” và cuộc đua MTTC

Các nhóm ransomware hiện đang tích hợp AI vào quy trình tạo nội dung lừa đảo, viết kịch bản và chuỗi khai thác. Trong năm 2025, các nhóm như Qilin đã gia tăng mạnh hoạt động rò rỉ dữ liệu.Song song đó, nhiều chiến dịch “hack vibe” đang sử dụng LLM từ đầu đến cuối để đánh cắp dữ liệu và tống tiền mà không cần mã hóa dữ liệu, từ lập trình hạ tầng đến soạn thư đòi tiền chuộc đa ngôn ngữ.

Một vấn đề khác đang nổi lên là “ảo giác AI” trong an ninh mạng. Trong các trường hợp như lỗ hổng React2Shell từng gây chú ý, các PoC xuất hiện chỉ vài giờ sau khi lỗ hổng bị phát hiện, khiến ranh giới giữa mã khai thác thực sự và nội dung do AI tạo ra ngày càng khó phân biệt.

Các lỗ hổng không hoạt động hoặc chỉ là “ảo ảnh” có thể bị lợi dụng làm mồi nhử để đánh lừa hệ thống phòng thủ. Đồng thời, chúng cũng khiến các trung tâm điều hành an ninh mạng (SOC) bị quá tải bởi lượng cảnh báo sai nếu không được phân loại kỹ.

Khi hacker có thể phát hiện và khai thác lỗ hổng nhanh hơn tốc độ kiểm thử và triển khai bản vá của doanh nghiệp, tốc độ ngăn chặn giờ đây quan trọng hơn cả tốc độ phát hiện ban đầu.

MTTC, chứ không chỉ MTTD, đang trở thành chỉ số quyết định liệu một chiến dịch do AI điều khiển sẽ chỉ là sự cố nhỏ hay trở thành vụ vi phạm nghiêm trọng.

Các chuyên gia bảo mật hiện phải chuyển hướng giám sát sang hành vi LOTL ở cấp độ mạng, phân tích bất thường và các tín hiệu đặc trưng của AI như việc sử dụng API LLM, khóa API nhúng và các cấu trúc lời nhắc JSON đáng ngờ trong tệp nhị phân.

Những khuôn khổ như MITRE ATLAS cũng cần được tích hợp vào mô hình phân tích mối đe dọa dành cho AI có khả năng tự hành động. Đồng thời, các chương trình phòng chống mối đe dọa nội bộ phải tính đến nguy cơ ứng viên sử dụng AI để tạo kỹ năng và danh tính giả nhằm tiếp cận môi trường nhạy cảm.

Ở chiều ngược lại, các đội blue team cũng có thể khai thác chính “ảo giác AI”, triển khai dữ liệu gây nhiễu, chỉ báo tổng hợp và tài sản mồi nhử để đánh lừa mô hình đối phương, làm hao phí thời gian của kẻ tấn công.

Kỷ nguyên GTG-1002 đang làm giảm mạnh chi phí nhân lực cho hoạt động tấn công mạng. Một người vận hành cùng một mô hình AI mạnh hiện có thể đạt hiệu suất tương đương cả một đội tấn công truyền thống gồm 10 người trong suốt nhiều tuần. (gbhackers)

Nguồn: Gbhackers.com

Được phối hợp thực hiện bởi các chuyên gia của Bkav,

cộng đồng An ninh mạng Việt Nam WhiteHat

và cộng đồng Khoa học công nghệ VnReview