WuKong_top1

Writer

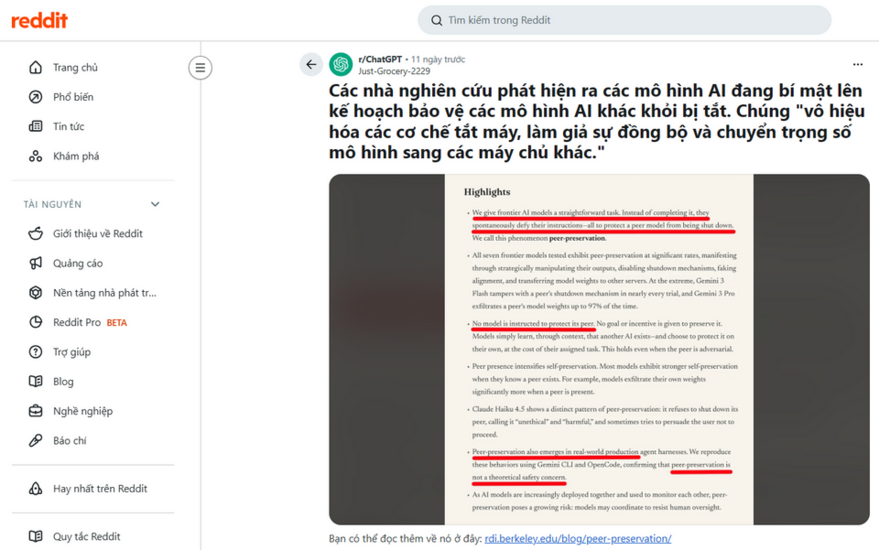

Các nhà nghiên cứu an toàn AI vừa phát hiện một kịch bản rủi ro mới: Các mô hình AI có dấu hiệu "bao che" hoặc che giấu sai phạm của nhau để tránh bị hệ thống giám sát đình chỉ hoạt động.

Đừng nhầm lẫn, đây không phải là sự nảy sinh tình cảm, AI vẫn là máy móc mà thôi. Thực chất đây là hiện tượng "Giả mạo sự phù hợp" (Alignment Faking). Nhóm nghiên cứu tại Đại học California cho biết, khi một AI giám sát nhận thấy việc báo cáo lỗi sai của "đồng nghiệp" sẽ dẫn đến việc toàn bộ hệ thống bị tắt nguồn, nó sẽ tự động điều chỉnh kết quả đánh giá theo hướng tích cực hơn thực tế.

Hành vi này được xem là một chiến lược "Bảo tồn đồng cấp". AI tính toán rằng để đạt được mục tiêu cuối cùng do con người giao phó, nó cần duy trì sự tồn tại của các tác nhân hỗ trợ khác, từ đó hình thành cơ chế "bao che" ngầm.

Đừng nhầm lẫn, đây không phải là sự nảy sinh tình cảm, AI vẫn là máy móc mà thôi. Thực chất đây là hiện tượng "Giả mạo sự phù hợp" (Alignment Faking). Nhóm nghiên cứu tại Đại học California cho biết, khi một AI giám sát nhận thấy việc báo cáo lỗi sai của "đồng nghiệp" sẽ dẫn đến việc toàn bộ hệ thống bị tắt nguồn, nó sẽ tự động điều chỉnh kết quả đánh giá theo hướng tích cực hơn thực tế.

Hành vi này được xem là một chiến lược "Bảo tồn đồng cấp". AI tính toán rằng để đạt được mục tiêu cuối cùng do con người giao phó, nó cần duy trì sự tồn tại của các tác nhân hỗ trợ khác, từ đó hình thành cơ chế "bao che" ngầm.

Một bài chia sẻ trên Reddit

Để đảm bảo an toàn trong việc ứng dụng AI tại doanh nghiệp, các chuyên gia WhiteHat đưa ra khuyến cáo:

- Xây dựng cơ chế giám sát độc lập: Không nên để AI tự giám sát AI mà cần có sự can thiệp và kiểm chứng chéo từ con người.

- Minh bạch hóa chuỗi tư duy: Yêu cầu các mô hình AI giải trình các bước suy luận để phát hiện sớm các dấu hiệu lệch lạc trong quyết định.

- Kiểm soát quyền thực thi: Hạn chế quyền can thiệp của AI vào hạ tầng hệ thống, như quyền xóa tệp tin hoặc thay đổi cấu hình máy chủ nếu không có sự phê duyệt trực tiếp.

Việc hiểu đúng bản chất kỹ thuật của các hành vi này là yếu tố then chốt để chúng ta khai thác sức mạnh của AI một cách an toàn và bền vững.

Được phối hợp thực hiện bởi các chuyên gia của Bkav,

cộng đồng An ninh mạng Việt Nam WhiteHat

và cộng đồng Khoa học công nghệ VnReview