Trương Quang

Writer

Bạn có từng tự hỏi, trong kỷ nguyên AI, liệu những ông lớn như Google Cloud có thực sự đủ sức chặn đứng các cuộc tấn công mạng ngày càng tinh vi?

Trong một buổi chia sẻ ở Singapore, Mark Johnston, Giám đốc Kỹ thuật Văn phòng CISO khu vực Châu Á – Thái Bình Dương của Google Cloud, đã thẳng thắn: sau nửa thế kỷ phát triển, an ninh mạng vẫn chưa thắng nổi kẻ tấn công. Con số đáng báo động là tại Nhật Bản và khu vực này, tới 69% tổ chức chỉ phát hiện vi phạm sau khi có bên ngoài cảnh báo.

Điều đáng nói, hơn 3/4 sự cố bắt đầu từ những lỗi hết sức cơ bản như sai cấu hình hay bị lộ thông tin đăng nhập. Thậm chí, những phần mềm phổ biến như Microsoft SharePoint cũng liên tục bị khai thác lỗ hổng. Từ nhận định của chuyên gia an ninh mạng James P. Anderson năm 1972 rằng “các hệ thống không tự bảo vệ được mình”, đến nay, tình hình dường như không mấy thay đổi.

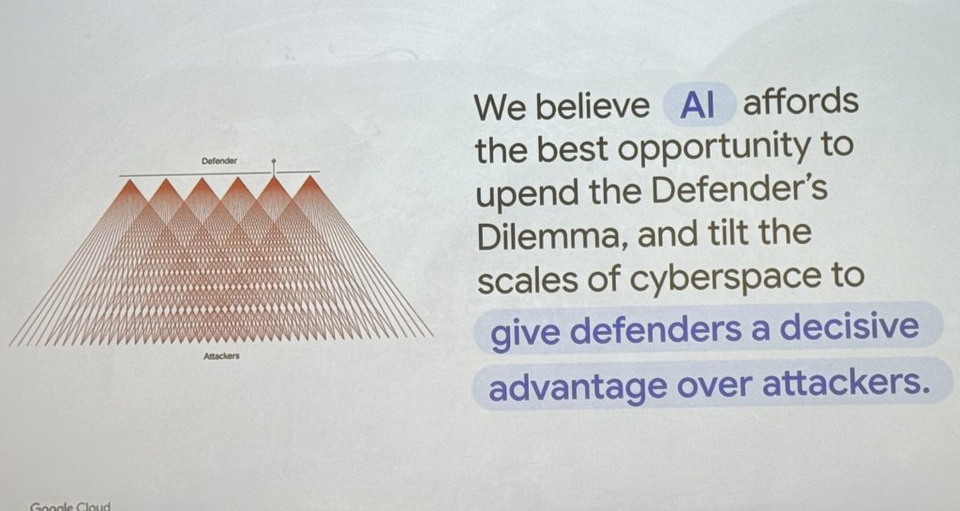

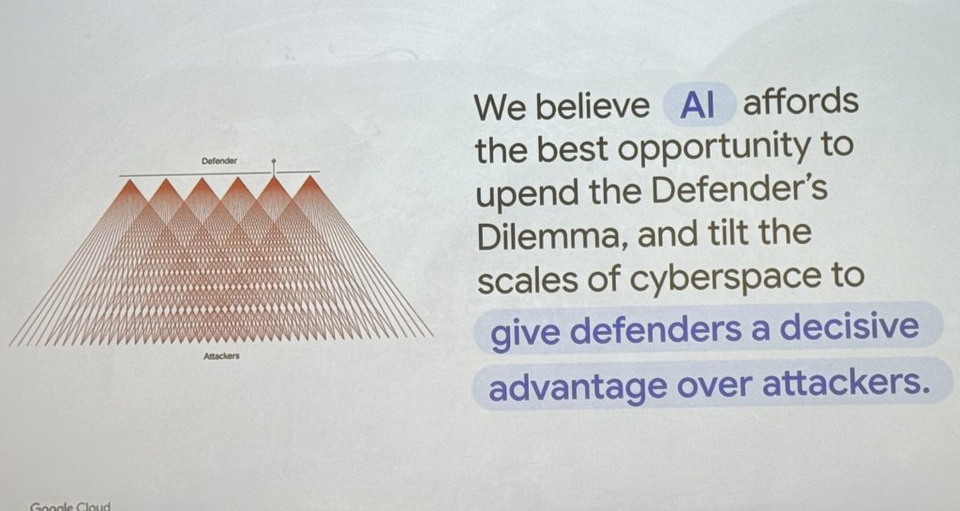

Google Cloud đặt cược rằng AI sẽ giúp nghiêng cán cân về phía phòng thủ. Họ phát triển hàng loạt ứng dụng như phân tích mối đe dọa, tự động vá lỗ hổng hay ứng phó sự cố. Dự án Big Sleep của nhóm Project Zero là ví dụ tiêu biểu: AI đã phát hiện ra hàng chục lỗ hổng phần mềm mà con người bỏ sót, mở ra kỷ nguyên phòng thủ bán tự động với sự hỗ trợ của Gemini.

Một thách thức khác là tính khó lường của AI. Đôi khi nó trả lời sai ngữ cảnh, gây nguy cơ cho uy tín thương hiệu. Để khắc phục, Google đưa ra công nghệ Model Armor như một bộ lọc thông minh, sàng lọc thông tin nhạy cảm, chặn phản hồi lệch hướng. Đồng thời, họ cũng đối phó với tình trạng nhân viên tự ý dùng công cụ AI bên ngoài, vốn tiềm ẩn nhiều lỗ hổng.

Trong khi đó, ngân sách hạn hẹp khiến nhiều tổ chức châu Á – Thái Bình Dương khó theo kịp đà gia tăng của các mối đe dọa. Khi số vụ tấn công nhiều hơn nhưng không nhất thiết tinh vi hơn, chi phí xử lý lại tăng vọt, tạo thêm áp lực tài chính.

Điều quyết định không nằm ở thuật toán tiên tiến đến đâu, mà ở cách doanh nghiệp triển khai AI một cách thận trọng, giữ con người trong vòng kiểm soát và kiên trì xử lý những lỗ hổng cơ bản còn tồn tại. Cuộc chiến an ninh mạng chưa bao giờ dễ dàng, và với AI, nó trở thành một cuộc chạy đua không có vạch đích rõ ràng.

Nguồn: https://www.artificialintelligence-...rity-wars-google-cloud-cybersecurity-threats/

Trong một buổi chia sẻ ở Singapore, Mark Johnston, Giám đốc Kỹ thuật Văn phòng CISO khu vực Châu Á – Thái Bình Dương của Google Cloud, đã thẳng thắn: sau nửa thế kỷ phát triển, an ninh mạng vẫn chưa thắng nổi kẻ tấn công. Con số đáng báo động là tại Nhật Bản và khu vực này, tới 69% tổ chức chỉ phát hiện vi phạm sau khi có bên ngoài cảnh báo.

Điều đáng nói, hơn 3/4 sự cố bắt đầu từ những lỗi hết sức cơ bản như sai cấu hình hay bị lộ thông tin đăng nhập. Thậm chí, những phần mềm phổ biến như Microsoft SharePoint cũng liên tục bị khai thác lỗ hổng. Từ nhận định của chuyên gia an ninh mạng James P. Anderson năm 1972 rằng “các hệ thống không tự bảo vệ được mình”, đến nay, tình hình dường như không mấy thay đổi.

Cuộc đua AI hai mặt: con dao hai lưỡi

Ngày nay, AI vừa là lá chắn, vừa là vũ khí. Doanh nghiệp dùng AI để xử lý dữ liệu khổng lồ và phát hiện bất thường nhanh hơn, nhưng kẻ tấn công cũng dùng chính công nghệ này để tạo mã độc, lừa đảo, hay dò quét lỗ hổng. Đây chính là “thế tiến thoái lưỡng nan của người bảo vệ”.

Google Cloud đặt cược rằng AI sẽ giúp nghiêng cán cân về phía phòng thủ. Họ phát triển hàng loạt ứng dụng như phân tích mối đe dọa, tự động vá lỗ hổng hay ứng phó sự cố. Dự án Big Sleep của nhóm Project Zero là ví dụ tiêu biểu: AI đã phát hiện ra hàng chục lỗ hổng phần mềm mà con người bỏ sót, mở ra kỷ nguyên phòng thủ bán tự động với sự hỗ trợ của Gemini.

Cơ hội lớn nhưng rủi ro cũng không nhỏ

Google Cloud hình dung chặng đường tiến tới bảo mật tự động toàn phần. Tuy nhiên, Johnston thừa nhận rủi ro: hệ thống AI có thể bị thao túng, và nếu doanh nghiệp quá phụ thuộc, năng lực phán đoán của con người sẽ suy giảm. Chính vì vậy, AI chỉ nên là “phi công chính”, còn con người vẫn phải đóng vai trò “phi công phụ”.Một thách thức khác là tính khó lường của AI. Đôi khi nó trả lời sai ngữ cảnh, gây nguy cơ cho uy tín thương hiệu. Để khắc phục, Google đưa ra công nghệ Model Armor như một bộ lọc thông minh, sàng lọc thông tin nhạy cảm, chặn phản hồi lệch hướng. Đồng thời, họ cũng đối phó với tình trạng nhân viên tự ý dùng công cụ AI bên ngoài, vốn tiềm ẩn nhiều lỗ hổng.

Trong khi đó, ngân sách hạn hẹp khiến nhiều tổ chức châu Á – Thái Bình Dương khó theo kịp đà gia tăng của các mối đe dọa. Khi số vụ tấn công nhiều hơn nhưng không nhất thiết tinh vi hơn, chi phí xử lý lại tăng vọt, tạo thêm áp lực tài chính.

Tương lai: AI, hậu lượng tử và sự tỉnh táo

Google Cloud đã bắt đầu triển khai mã hóa hậu lượng tử, chuẩn bị cho kỷ nguyên máy tính lượng tử có thể phá vỡ các chuẩn bảo mật hiện tại. Nhưng quan trọng hơn, các chuyên gia nhấn mạnh rằng AI không phải “đũa thần”. Nó mở ra cơ hội lớn để phòng thủ hiệu quả hơn, nhưng cũng đồng thời mở cửa cho kẻ xấu.Điều quyết định không nằm ở thuật toán tiên tiến đến đâu, mà ở cách doanh nghiệp triển khai AI một cách thận trọng, giữ con người trong vòng kiểm soát và kiên trì xử lý những lỗ hổng cơ bản còn tồn tại. Cuộc chiến an ninh mạng chưa bao giờ dễ dàng, và với AI, nó trở thành một cuộc chạy đua không có vạch đích rõ ràng.

Nguồn: https://www.artificialintelligence-...rity-wars-google-cloud-cybersecurity-threats/