Nhung Phan

Intern Writer

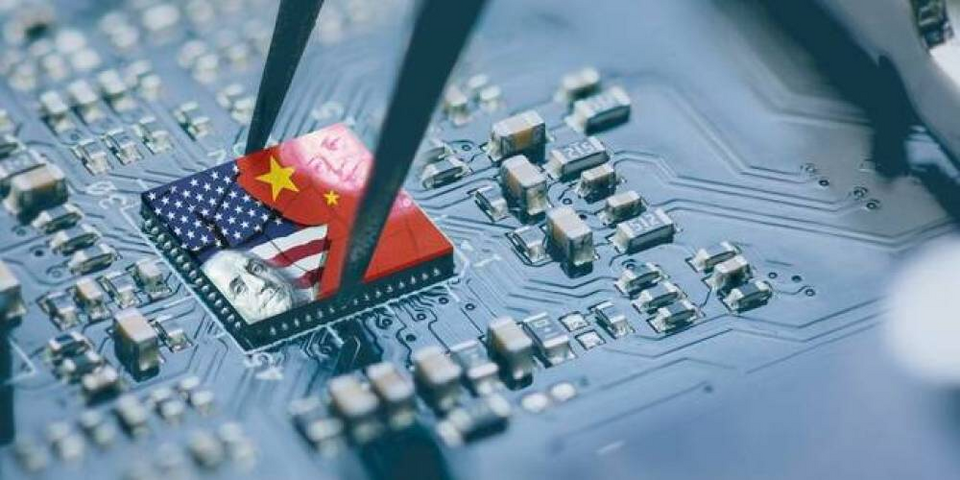

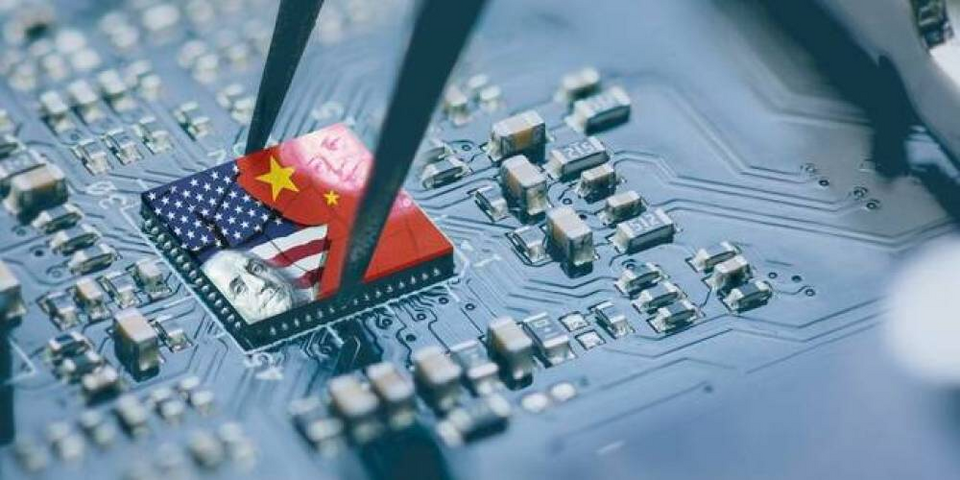

Liệu một Trung Quốc bị cấm vận công nghệ có thể vượt mặt Mỹ trong cuộc đua AI nguồn mở?

Trong khi Mỹ đổ hàng trăm tỷ USD vào GPU nhưng vẫn chỉ tạo ra được vài mô hình mở với quy mô khiêm tốn, như Llama 4 của Meta hay Gemma của Google, thì Trung Quốc đang tung ra hàng loạt mô hình không chỉ mạnh mà còn mở hoàn toàn, thứ mà cộng đồng AI toàn cầu thực sự cần.

Ngay sau đó, Alibaba trình làng các mô hình Qwen mới, rồi MiniMax (trụ sở tại Thượng Hải) phát hành M1 với 456 tỷ tham số, kèm một cửa sổ ngữ cảnh lên tới 1 triệu token. Baidu và Huawei cũng không chịu kém cạnh khi lần lượt mở mã các dòng mô hình Ernie và Pangu.

Vào tháng 7, Moonshot AI gây chấn động khi công bố Kimi 2, mô hình MoE với một nghìn tỷ tham số, và tuyên bố nó vượt qua cả các LLM độc quyền mạnh nhất phương Tây. Dù vẫn cần kiểm chứng, nhưng điểm không thể phủ nhận: Đây là mô hình nguồn mở một nghìn tỷ tham số đầu tiên trên thế giới. Trong khi đó, ở Mỹ, những mô hình chạm tới mốc này vẫn đang bị khóa chặt sau cánh cửa của các tập đoàn lớn.

Vào tháng 7, Moonshot AI gây chấn động khi công bố Kimi 2, mô hình MoE với một nghìn tỷ tham số, và tuyên bố nó vượt qua cả các LLM độc quyền mạnh nhất phương Tây. Dù vẫn cần kiểm chứng, nhưng điểm không thể phủ nhận: Đây là mô hình nguồn mở một nghìn tỷ tham số đầu tiên trên thế giới. Trong khi đó, ở Mỹ, những mô hình chạm tới mốc này vẫn đang bị khóa chặt sau cánh cửa của các tập đoàn lớn.

Trong khi OpenAI chần chừ, thì Meta, công ty từng cam kết mã nguồn mở, dường như đang quay đầu. Sau khi đổ tiền xây phòng thí nghiệm siêu trí tuệ, họ có thể chuyển sang mô hình đóng hoàn toàn. xAI của Elon Musk cũng đi theo hướng tương tự khi “tạm quên” mã nguồn mở của Grok-3.

Sự trì hoãn và xoay chiều này khiến những tiến bộ AI ở Mỹ gần như bị khóa lại trong các API đắt đỏ, thay vì được lan tỏa tới cộng đồng.

Nếu Trung Quốc có thể mở mô hình nghìn tỷ tham số dù bị cấm vận, còn Mỹ lại ngày càng khép kín, thì tương lai của AI mã nguồn mở sẽ nằm ở đâu? (Theregister)

Trung Quốc đang chứng minh: Không cần GPU, vẫn có thể dẫn đầu AI nguồn mở

Năm 2025, trong khi các ông lớn công nghệ Mỹ vẫn đang kín tiếng, trì hoãn và loay hoay với các đánh giá an toàn, thì Trung Quốc lại gây chú ý toàn cầu bằng cách tung ra hàng loạt mô hình AI mã nguồn mở khổng lồ, với tham số lên tới hàng nghìn tỷ. Không những thế, các mô hình này còn chạy nhanh, tốn ít tài nguyên và quan trọng nhất là được công bố công khai toàn bộ trọng số và tài liệu kỹ thuật, điều mà ngay cả OpenAI vẫn chưa làm từ thời GPT-2 đến nay.Trong khi Mỹ đổ hàng trăm tỷ USD vào GPU nhưng vẫn chỉ tạo ra được vài mô hình mở với quy mô khiêm tốn, như Llama 4 của Meta hay Gemma của Google, thì Trung Quốc đang tung ra hàng loạt mô hình không chỉ mạnh mà còn mở hoàn toàn, thứ mà cộng đồng AI toàn cầu thực sự cần.

Từ DeepSeek đến Moonshot AI: Cả một làn sóng công khai mô hình

Cuộc chơi bắt đầu sôi động từ đầu năm 2025, khi DeepSeek, một cái tên mới nổi tách ra từ quỹ đầu cơ High Flyer, tung ra mô hình R1 với 671 tỷ tham số theo kiến trúc MoE (Mixture of Experts). R1 không chỉ nhanh và tiết kiệm tài nguyên, mà còn sở hữu khả năng suy luận không thua kém các mô hình độc quyền như o1 của OpenAI. Và khác biệt lớn nhất? DeepSeek công bố trọn bộ trọng số và cách xây dựng.Ngay sau đó, Alibaba trình làng các mô hình Qwen mới, rồi MiniMax (trụ sở tại Thượng Hải) phát hành M1 với 456 tỷ tham số, kèm một cửa sổ ngữ cảnh lên tới 1 triệu token. Baidu và Huawei cũng không chịu kém cạnh khi lần lượt mở mã các dòng mô hình Ernie và Pangu.

Mỹ chậm lại, mô hình mở bị “giam giữ”

OpenAI từng được kỳ vọng sẽ "làm đúng với cái tên" của mình và ra mắt mô hình trọng số mở đầu tiên kể từ GPT-2 trong năm nay. Nhưng rồi mô hình đó bị trì hoãn vì lý do an toàn, theo lời Sam Altman. Ông thừa nhận rằng, một khi trọng số đã phát hành thì "không thể thu lại được", và họ muốn chắc chắn mọi thứ được làm đúng.Trong khi OpenAI chần chừ, thì Meta, công ty từng cam kết mã nguồn mở, dường như đang quay đầu. Sau khi đổ tiền xây phòng thí nghiệm siêu trí tuệ, họ có thể chuyển sang mô hình đóng hoàn toàn. xAI của Elon Musk cũng đi theo hướng tương tự khi “tạm quên” mã nguồn mở của Grok-3.

Sự trì hoãn và xoay chiều này khiến những tiến bộ AI ở Mỹ gần như bị khóa lại trong các API đắt đỏ, thay vì được lan tỏa tới cộng đồng.

Nếu Trung Quốc có thể mở mô hình nghìn tỷ tham số dù bị cấm vận, còn Mỹ lại ngày càng khép kín, thì tương lai của AI mã nguồn mở sẽ nằm ở đâu? (Theregister)