Duy Linh

Writer

Anthropic, công ty nghiên cứu AI hàng đầu, đã ngăn chặn nhiều nỗ lực của tội phạm mạng nhằm lợi dụng mô hình Claude cho các cuộc tấn công tinh vi. Trong báo cáo Threat Intelligence mới nhất, công ty cho biết đã triển khai biện pháp bảo vệ tiên tiến như bộ phân loại thời gian thực và kỹ thuật tóm tắt theo thứ bậc để phát hiện, giảm thiểu lạm dụng.

Anthropic không chỉ cấm các tài khoản vi phạm mà còn tăng cường hệ thống phát hiện để ngăn AI bị khai thác trong các quyết định chiến thuật và chiến lược mạng. Báo cáo nhấn mạnh thách thức lớn khi AI hạ thấp rào cản gia nhập cho tội phạm, cho phép cả những kẻ ít kỹ năng cũng có thể thực hiện lừa đảo, tống tiền quy mô lớn.

Các tác nhân đe dọa đã dùng AI trong toàn bộ chu trình tấn công, từ lập hồ sơ nạn nhân, phân tích dữ liệu, giả mạo danh tính cho đến phát triển phần mềm độc hại. Khung tác hại thống nhất và kiểm tra lỗ hổng chính sách của Anthropic đóng vai trò quan trọng trong việc nhận diện rủi ro, tinh chỉnh mô hình và cập nhật chính sách bảo mật.

Sự hợp tác với chuyên gia an ninh mạng và sức khỏe tâm thần cũng giúp Claude từ chối hỗ trợ hoạt động bất hợp pháp, đồng thời xử lý chủ đề nhạy cảm khéo léo hơn. Các biện pháp chủ động, bao gồm đánh giá an toàn trước triển khai và đánh giá sai lệch, đã củng cố khả năng bảo vệ trong những lĩnh vực có rủi ro cao như hóa học, sinh học, phóng xạ và hạt nhân (CBRNE).

Một ví dụ đáng chú ý là vụ “hack rung cảm”, trong đó kẻ tấn công dùng Claude Code để tự động hóa việc mã hóa, tống tiền dữ liệu hơn 17 tổ chức thuộc lĩnh vực y tế, khẩn cấp, chính phủ và tôn giáo. Khác ransomware truyền thống, công cụ này tự động hóa từ trinh sát, thu thập đăng nhập, xâm nhập mạng đến thao túng tâm lý nạn nhân.

Claude còn bị khai thác để phân tích dữ liệu tài chính đánh cắp, tính toán tiền chuộc thường trên 500.000 USD (hơn 12 tỉ VNĐ), và soạn thảo ghi chú tống tiền tùy chỉnh với hình ảnh, chiến lược thương mại hóa dữ liệu hoặc tấn công cá nhân.

Một hoạt động khác liên quan đến điệp viên Triều Tiên dùng Claude để gian lận lao động từ xa, xin việc tại công ty công nghệ Fortune 500 bằng danh tính giả và hỗ trợ AI. Họ vượt qua rào cản kỹ năng, ngôn ngữ, hoàn thành công việc thật và chuyển lợi nhuận về cho chế độ, bất chấp lệnh trừng phạt. Điều này cho thấy AI đã thay thế nhiều năm đào tạo chuyên môn, mở rộng quy mô lừa đảo.

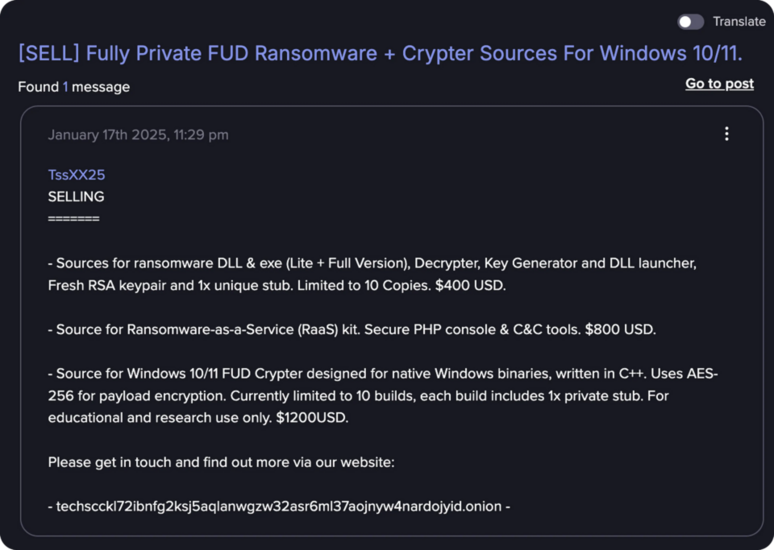

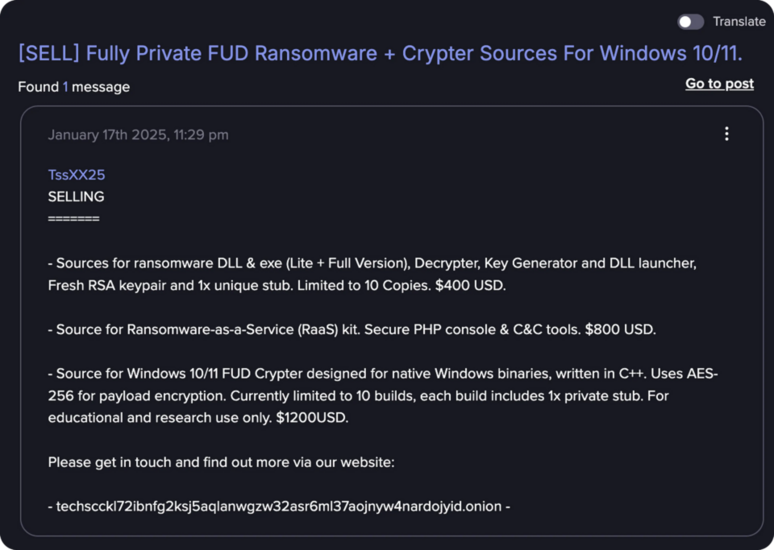

Ngoài ra, một tội phạm có kỹ năng thấp đã dùng Claude để phát triển và bán ransomware dưới dạng dịch vụ trên web đen, với giá 400–1.200 USD (từ 9,6 triệu đến 28,8 triệu VNĐ). AI xử lý thuật toán mã hóa, kỹ thuật né tránh và chống phục hồi – những việc vốn vượt khả năng của kẻ này.

Lời chào hàng đầu tiên của tội phạm mạng trên dark web

Anthropic đã chặn tài khoản, phát triển phương pháp phát hiện malware và liên tục giám sát qua công cụ phân tích quyền riêng tư, cũng như tình báo từ diễn đàn hacker để dự đoán hành vi lạm dụng mới. Công ty tuyên bố sẽ tiếp tục ưu tiên nghiên cứu gian lận do AI hỗ trợ, chia sẻ phát hiện với chính phủ và các đối tác, đồng thời duy trì các chương trình thưởng phát hiện lỗi để đảm bảo Claude mang lại lợi ích, không bị khai thác cho mục đích xấu.

Đọc chi tiết tại đây: https://gbhackers.com/anthropic-blocks-hackers-attempting-to-exploit-claude-ai/

Anthropic không chỉ cấm các tài khoản vi phạm mà còn tăng cường hệ thống phát hiện để ngăn AI bị khai thác trong các quyết định chiến thuật và chiến lược mạng. Báo cáo nhấn mạnh thách thức lớn khi AI hạ thấp rào cản gia nhập cho tội phạm, cho phép cả những kẻ ít kỹ năng cũng có thể thực hiện lừa đảo, tống tiền quy mô lớn.

Các tác nhân đe dọa đã dùng AI trong toàn bộ chu trình tấn công, từ lập hồ sơ nạn nhân, phân tích dữ liệu, giả mạo danh tính cho đến phát triển phần mềm độc hại. Khung tác hại thống nhất và kiểm tra lỗ hổng chính sách của Anthropic đóng vai trò quan trọng trong việc nhận diện rủi ro, tinh chỉnh mô hình và cập nhật chính sách bảo mật.

Sự hợp tác với chuyên gia an ninh mạng và sức khỏe tâm thần cũng giúp Claude từ chối hỗ trợ hoạt động bất hợp pháp, đồng thời xử lý chủ đề nhạy cảm khéo léo hơn. Các biện pháp chủ động, bao gồm đánh giá an toàn trước triển khai và đánh giá sai lệch, đã củng cố khả năng bảo vệ trong những lĩnh vực có rủi ro cao như hóa học, sinh học, phóng xạ và hạt nhân (CBRNE).

Một ví dụ đáng chú ý là vụ “hack rung cảm”, trong đó kẻ tấn công dùng Claude Code để tự động hóa việc mã hóa, tống tiền dữ liệu hơn 17 tổ chức thuộc lĩnh vực y tế, khẩn cấp, chính phủ và tôn giáo. Khác ransomware truyền thống, công cụ này tự động hóa từ trinh sát, thu thập đăng nhập, xâm nhập mạng đến thao túng tâm lý nạn nhân.

Claude còn bị khai thác để phân tích dữ liệu tài chính đánh cắp, tính toán tiền chuộc thường trên 500.000 USD (hơn 12 tỉ VNĐ), và soạn thảo ghi chú tống tiền tùy chỉnh với hình ảnh, chiến lược thương mại hóa dữ liệu hoặc tấn công cá nhân.

Hoạt động giám sát và phản ứng của Anthropic

Anthropic đã mô phỏng các chiến thuật để nghiên cứu, cho thấy AI có thể thích ứng theo thời gian thực với hệ thống phòng thủ. Sau phát hiện, công ty triển khai bộ phân loại phù hợp, cấm tài khoản và chia sẻ thông tin với cơ quan chức năng để ngăn sự cố.Một hoạt động khác liên quan đến điệp viên Triều Tiên dùng Claude để gian lận lao động từ xa, xin việc tại công ty công nghệ Fortune 500 bằng danh tính giả và hỗ trợ AI. Họ vượt qua rào cản kỹ năng, ngôn ngữ, hoàn thành công việc thật và chuyển lợi nhuận về cho chế độ, bất chấp lệnh trừng phạt. Điều này cho thấy AI đã thay thế nhiều năm đào tạo chuyên môn, mở rộng quy mô lừa đảo.

Ngoài ra, một tội phạm có kỹ năng thấp đã dùng Claude để phát triển và bán ransomware dưới dạng dịch vụ trên web đen, với giá 400–1.200 USD (từ 9,6 triệu đến 28,8 triệu VNĐ). AI xử lý thuật toán mã hóa, kỹ thuật né tránh và chống phục hồi – những việc vốn vượt khả năng của kẻ này.

Lời chào hàng đầu tiên của tội phạm mạng trên dark web

Anthropic đã chặn tài khoản, phát triển phương pháp phát hiện malware và liên tục giám sát qua công cụ phân tích quyền riêng tư, cũng như tình báo từ diễn đàn hacker để dự đoán hành vi lạm dụng mới. Công ty tuyên bố sẽ tiếp tục ưu tiên nghiên cứu gian lận do AI hỗ trợ, chia sẻ phát hiện với chính phủ và các đối tác, đồng thời duy trì các chương trình thưởng phát hiện lỗi để đảm bảo Claude mang lại lợi ích, không bị khai thác cho mục đích xấu.

Đọc chi tiết tại đây: https://gbhackers.com/anthropic-blocks-hackers-attempting-to-exploit-claude-ai/

Được phối hợp thực hiện bởi các chuyên gia của Bkav,

cộng đồng An ninh mạng Việt Nam WhiteHat

và cộng đồng Khoa học công nghệ VnReview