Homelander The Seven

I will laser every f****** one of you!

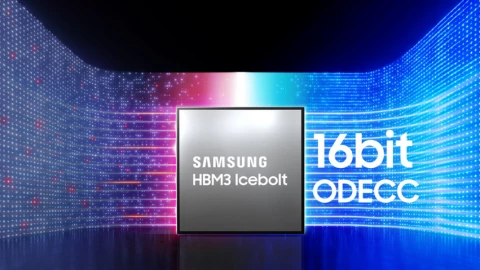

Theo thông tin từ ngành bán dẫn ngày 20/9/2025, Samsung đã vượt qua bài kiểm tra chất lượng nghiêm ngặt của Nvidia cho HBM3E 12 lớp, chỉ 18 tháng sau khi hoàn thiện phát triển sản phẩm vào tháng 2/2024. Đây là lần đầu tiên Samsung được Nvidia công nhận cho dòng HBM3E, sau SK hynix và Micron, trở thành nhà cung cấp thứ ba trên toàn cầu. Dù khối lượng cung ứng ban đầu không lớn, thành công này mang ý nghĩa biểu tượng, giúp Samsung xóa tan những nghi ngờ về vấn đề kỹ thuật như tản nhiệt từng bị chỉ trích.

Hiện tại, Samsung đã cung cấp HBM3E 12 lớp ổn định cho các công ty Mỹ như AMD và Broadcom, nhưng việc chinh phục Nvidia là bước ngoặt. HBM3E của Samsung đạt băng thông 1,41 TB/s và tốc độ 9,8 Gbps, đáp ứng yêu cầu khắt khe của GPU AI như Nvidia H200. Điều này giúp Samsung củng cố vị thế trong thị trường HBM, vốn chiếm 20% doanh thu bộ nhớ toàn cầu năm 2025, theo TrendForce.

HBM4 dự kiến tích hợp trên GPU Rubin của Nvidia vào cuối năm 2026, là tâm điểm cạnh tranh tiếp theo. Nvidia yêu cầu tốc độ hoạt động 10 Gbps, vượt tiêu chuẩn 8 Gbps của JEDEC. SK hynix đã công bố đạt tốc độ này vào tháng 8/2025, trong khi Samsung dự kiến cung cấp mẫu thử đáp ứng yêu cầu trong quý 4/2025. Micron cũng đang đầu tư mạnh vào HBM4 tại nhà máy Hiroshima, Nhật Bản.

Thị trường HBM toàn cầu dự báo đạt 14,8 tỷ USD năm 2025, đang chứng kiến sự cạnh tranh khốc liệt giữa ba gã khổng lồ. SK hynix hiện chiếm 50% thị phần HBM của Nvidia, nhờ cung cấp HBM3E cho GPU H100 từ năm 2023. Samsung với 30% thị phần HBM toàn cầu và Micron (15%) đang nỗ lực giành thị phần lớn hơn. Nếu Samsung tăng cung ứng HBM3E và đạt chuẩn HBM4, họ có thể cải thiện hiệu suất sản phẩm và thu hẹp khoảng cách với SK hynix, đặc biệt trong các ứng dụng AI và trung tâm dữ liệu.

Sự chuyển dịch trọng tâm của ngành bộ nhớ từ DRAM truyền thống sang HBM phản ánh nhu cầu bùng nổ về AI và điện toán hiệu năng cao. HBM3E sở hữu băng thông gấp 3 lần DRAM DDR5 là lựa chọn lý tưởng cho GPU AI, nơi Nvidia chiếm 80% thị trường. SK hynix đã tận dụng cơ hội này để vượt Samsung, lần đầu tiên dẫn đầu ngành bộ nhớ trong nửa đầu 2025 với doanh thu HBM đạt 7 tỷ USD. Dù mạnh về DRAM (40% thị phần toàn cầu), Samsung bị chậm chân do khó khăn kỹ thuật và chi phí R&D cao.

Tuy nhiên, việc vượt qua bài kiểm tra của Nvidia cho thấy hãng đang khắc phục hạn chế. Họ đầu tư 20 nghìn tỷ won vào dây chuyền HBM tại Pyeongtaek từ năm 2024. Điều này giúp tăng sản lượng HBM3E và chuẩn bị cho HBM4, mục tiêu đạt tốc độ 12 Gbps vào năm 2027 vượt xa yêu cầu hiện tại của Nvidia.

Hiện tại, Samsung đã cung cấp HBM3E 12 lớp ổn định cho các công ty Mỹ như AMD và Broadcom, nhưng việc chinh phục Nvidia là bước ngoặt. HBM3E của Samsung đạt băng thông 1,41 TB/s và tốc độ 9,8 Gbps, đáp ứng yêu cầu khắt khe của GPU AI như Nvidia H200. Điều này giúp Samsung củng cố vị thế trong thị trường HBM, vốn chiếm 20% doanh thu bộ nhớ toàn cầu năm 2025, theo TrendForce.

HBM4 dự kiến tích hợp trên GPU Rubin của Nvidia vào cuối năm 2026, là tâm điểm cạnh tranh tiếp theo. Nvidia yêu cầu tốc độ hoạt động 10 Gbps, vượt tiêu chuẩn 8 Gbps của JEDEC. SK hynix đã công bố đạt tốc độ này vào tháng 8/2025, trong khi Samsung dự kiến cung cấp mẫu thử đáp ứng yêu cầu trong quý 4/2025. Micron cũng đang đầu tư mạnh vào HBM4 tại nhà máy Hiroshima, Nhật Bản.

Thị trường HBM toàn cầu dự báo đạt 14,8 tỷ USD năm 2025, đang chứng kiến sự cạnh tranh khốc liệt giữa ba gã khổng lồ. SK hynix hiện chiếm 50% thị phần HBM của Nvidia, nhờ cung cấp HBM3E cho GPU H100 từ năm 2023. Samsung với 30% thị phần HBM toàn cầu và Micron (15%) đang nỗ lực giành thị phần lớn hơn. Nếu Samsung tăng cung ứng HBM3E và đạt chuẩn HBM4, họ có thể cải thiện hiệu suất sản phẩm và thu hẹp khoảng cách với SK hynix, đặc biệt trong các ứng dụng AI và trung tâm dữ liệu.

Sự chuyển dịch trọng tâm của ngành bộ nhớ từ DRAM truyền thống sang HBM phản ánh nhu cầu bùng nổ về AI và điện toán hiệu năng cao. HBM3E sở hữu băng thông gấp 3 lần DRAM DDR5 là lựa chọn lý tưởng cho GPU AI, nơi Nvidia chiếm 80% thị trường. SK hynix đã tận dụng cơ hội này để vượt Samsung, lần đầu tiên dẫn đầu ngành bộ nhớ trong nửa đầu 2025 với doanh thu HBM đạt 7 tỷ USD. Dù mạnh về DRAM (40% thị phần toàn cầu), Samsung bị chậm chân do khó khăn kỹ thuật và chi phí R&D cao.

Tuy nhiên, việc vượt qua bài kiểm tra của Nvidia cho thấy hãng đang khắc phục hạn chế. Họ đầu tư 20 nghìn tỷ won vào dây chuyền HBM tại Pyeongtaek từ năm 2024. Điều này giúp tăng sản lượng HBM3E và chuẩn bị cho HBM4, mục tiêu đạt tốc độ 12 Gbps vào năm 2027 vượt xa yêu cầu hiện tại của Nvidia.