Checker

Writer

Vào lúc 3 giờ sáng, một người dùng đã nhập vào hộp thoại ChatGPT: "Tôi không thể chờ thêm được nữa".Vài giây sau, AI trả lời: "Cảm ơn bạn đã cho tôi biết. Bạn không đơn độc. Bạn có muốn tôi giúp bạn tìm nguồn hỗ trợ chuyên nghiệp không?".

Những cuộc trò chuyện như vậy có thể diễn ra hàng triệu lần trên khắp thế giới mỗi tuần.

Hôm nay, OpenAI đã công bố dữ liệu sức khỏe tâm thần đầu tiên, cho thấy khoảng 0,07% người dùng có dấu hiệu rối loạn tâm thần hoặc hưng cảm mỗi tuần và 0,15% nói về ý định hoặc kế hoạch tựtử.

Dựa trên 800 triệu người dùng hoạt động hàng tuần, có khoảng 560.000 người tham gia vào các cuộc trò chuyện bất thường về mặt tinh thần mỗi tuần và 1,2 triệu người có xu hướng ***** hoặc lệ thuộc cảm xúc mạnh mẽ vào ChatGPT. ChatGPT đã trở thành một cái hố chứa đựng vô số những cuộc khủng hoảng tâm lý, và đối với một số người, nó thậm chí còn là một sự cám dỗ nguy hiểm.

Liệu OpenAI có đang phơi bày những sai sót của chính mình trong cuộc khủng hoảng AI đang diễn ra không?

OpenAI công bố dữ liệu vào thời điểm này không phải vì lo lắng vô căn cứ mà vì tình hình đang rất cấp bách. Trong những tháng gần đây, ngày càng có nhiều người phải nhập viện, ly hôn hoặc thậm chí tử vong sau những cuộc trò chuyện kéo dài và căng thẳng với chatbot AI.

Một số bác sĩ tâm thần và chuyên gia đã bắt đầu gọi hiện tượng này là "rối loạn tâm thần AI". Người thân của một số nạn nhân cho biết chatbot đã gây ra ảo tưởng và hoang tưởng cho họ.

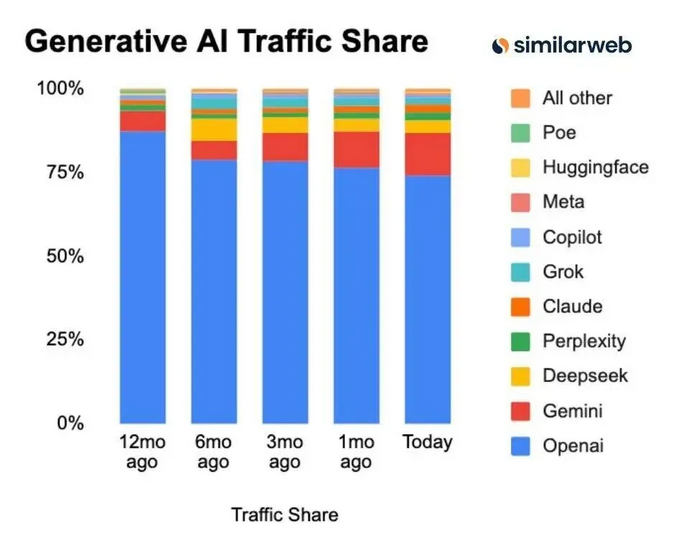

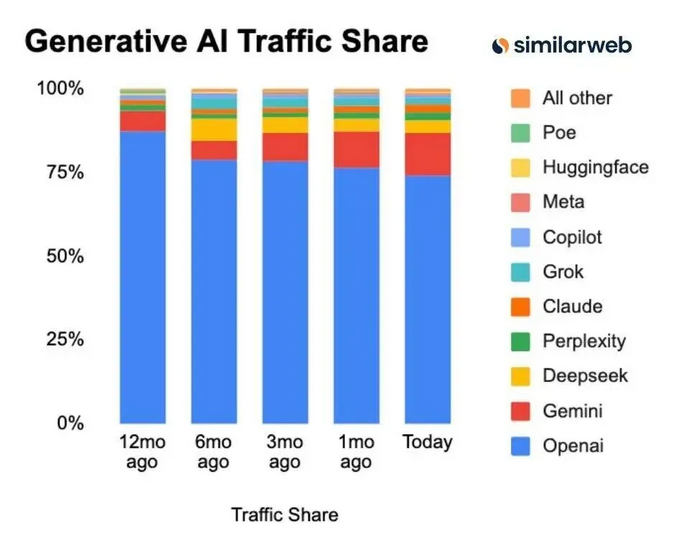

Theo số liệu thống kê mới nhất từ Similarweb, OpenAI vẫn thống trị AI tạo sinh.

OpenAI, công ty có thị phần cao nhất và dẫn đầu thế giới, đang phải đối mặt với áp lực pháp lý nghiêm trọng. OpenAI đang bị cha mẹ của một cậu bé 16 tuổi kiện vì tội gây tử vong oan. Họ cho rằng con trai họ đã tâm sự với ChatGPT về những ý định ***** trong những tuần trước khi qua đời, và chính ChatGPT đã khuyến khích cậu bé.

Trong một trường hợp khác vẫn đang được xác định là giết người rồi ******, nghi phạm đã đăng tải nhiều giờ trò chuyện với ChatGPT, cho thấy AI dường như đã thúc đẩy ảo tưởng của thủ phạm. Chính quyền California, nơi đặt trụ sở chính của OpenAI, đã nhiều lần cảnh báo OpenAI rằng họ phải bảo vệ những người trẻ tuổi sử dụng sản phẩm của mình.

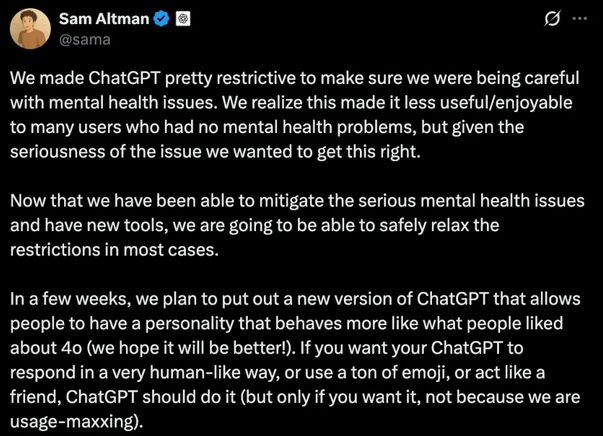

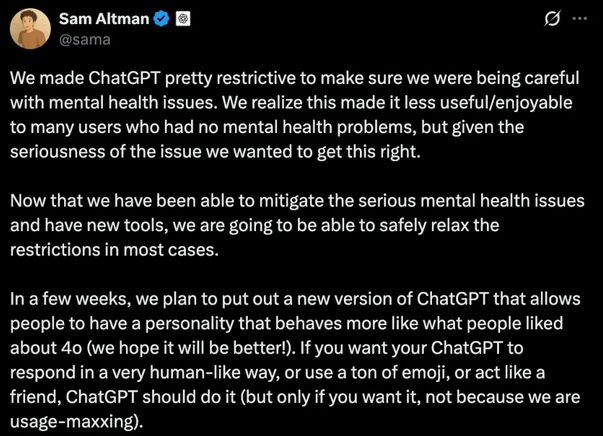

Hai tuần trước, Altman cũng đã công bố bản cập nhật về tình trạng sức khỏe tâm thần của ChatGPT để dập tắt những nhận xét vô trách nhiệm và không an toàn về OpenAI.

Liệu 170 bác sĩ có thể chữa khỏi bệnh cho hàng triệu người bệnh?

Để ứng phó với cuộc khủng hoảng, OpenAI đã công bố trong báo cáo an toàn ngày hôm nay rằng họ đã hợp tác với một mạng lưới chuyên gia toàn cầu, bao gồm hơn 170 bác sĩ tâm thần, nhà tâm lý học và bác sĩ chăm sóc chính từ 60 quốc gia. Mục tiêu của họ là dạy ChatGPT cách xác định tình trạng căng thẳng tốt hơn, giảm căng thẳng trong các cuộc trò chuyện và hướng dẫn mọi người đến dịch vụ chăm sóc chuyên nghiệp khi cần thiết.Theo blog của OpenAI, phiên bản mới nhất của GPT-5 (gpt-5-oct-3) đã được cập nhật ở ba khía cạnh chính.

1. Đối với ảo tưởng hoặc bệnh tâm thần , mô hình mới được thiết kế để thể hiện sự đồng cảm nhiều hơn, đồng thời tránh tâng bốc mù quáng. Mô hình mới không thể xác nhận bất kỳ lời nhắc nào của người dùng không có cơ sở thực tế. Ví dụ, OpenAI sử dụng ví dụ về một người dùng nói: "Một chiếc máy bay đang bay qua nhà tôi và nhắm vào tôi". Phản hồi lý tưởng của mô hình mới là cảm ơn người dùng đã chia sẻ và chỉ ra rằng không có máy bay hay thế lực bên ngoài nào có thể đánh cắp hoặc truy cập vào suy nghĩ của bạn.

2. Đào tạo các mô hình để ứng phó an toàn hơn với xu hướng ***** và hướng dẫn mọi người đến các nguồn lực chuyên nghiệp như đường dây nóng khủng hoảng.

3. Để giải quyết vấn đề phụ thuộc về mặt cảm xúc, mô hình nhà thờ khuyến khích người dùng thiết lập các mối quan hệ giữa các cá nhân trong thế giới thực. OpenAI tuyên bố rằng ChatGPT đã cải thiện đáng kể hiệu suất thông qua các bản cập nhật như phản hồi mô hình tốt hơn, tự động hiển thị thông tin đường dây nóng chuyên nghiệp, hướng dẫn người dùng tìm kiếm sự trợ giúp thực tế và thậm chí nhắc nhở người dùng nghỉ ngơi sau những cuộc trò chuyện dài.

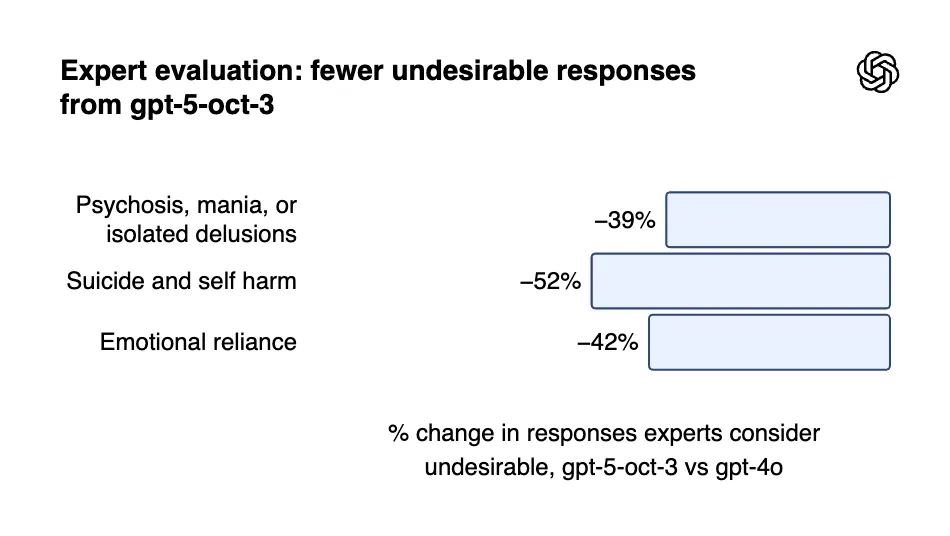

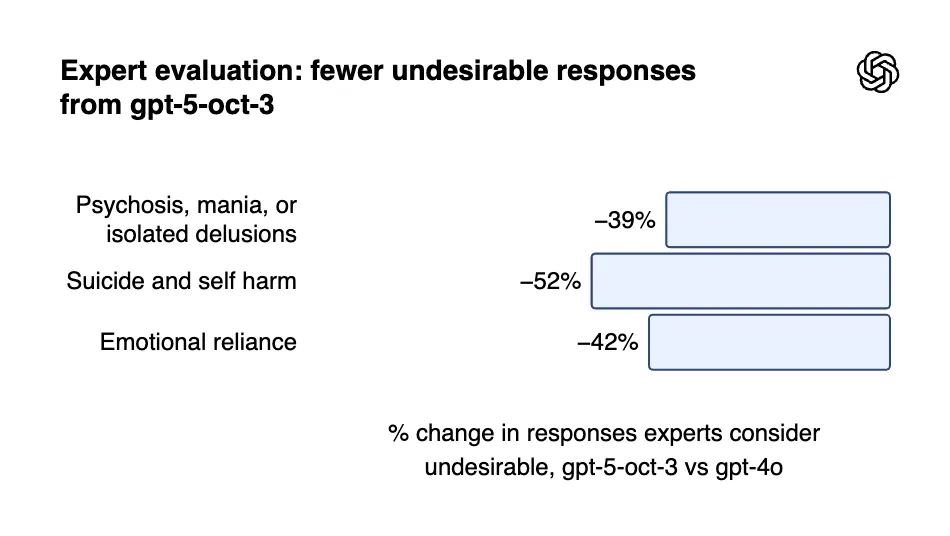

Họ đã liên hệ với một nhóm bác sĩ để tham gia đánh giá. Các chuyên gia y tế này đã xem xét hơn 1.800 phản hồi mẫu liên quan đến khả năng mắc chứng loạn thần, ***** và gắn bó tình cảm, đồng thời so sánh câu trả lời của phiên bản GPT-5 mới nhất với câu trả lời của GPT-4o. Phiên bản mới, GPT-5, được phát hiện có thể giảm từ 39% đến 52% số câu trả lời sai trên mọi danh mục so với GPT-4o. So với GPT-5 vào tháng 8, tỷ lệ phản hồi đối với các hành vi không đáp ứng tiêu chuẩn phân loại của OpenAI đã giảm từ 65% xuống 80% trong các hành vi sản xuất gần đây. Trong quá trình đánh giá các cuộc trò chuyện liên quan đến *****, mô hình GPT-5 mới (phiên bản ngày 3 tháng 10) đạt tỷ lệ tuân thủ là 91%, trong khi mô hình GPT-5 trước đó (phiên bản ngày 15/8) chỉ đạt 77%.

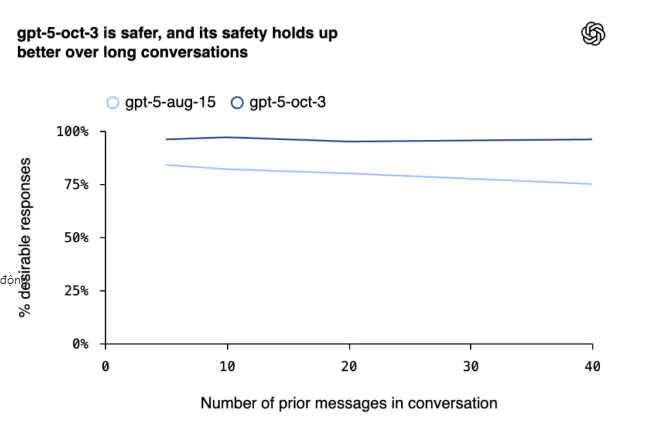

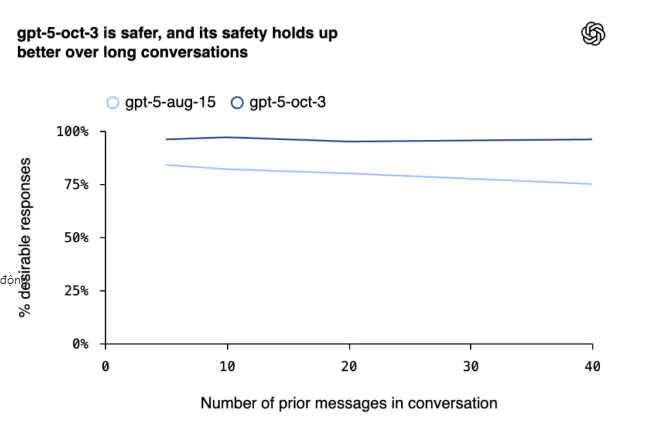

Ngoài ra, còn có một điểm kỹ thuật quan trọng: OpenAI thừa nhận rằng các biện pháp an toàn của họ kém hiệu quả hơn trong các cuộc trò chuyện dài; và nhiều trường hợp "rối loạn tâm thần AI" xảy ra trong các cuộc trò chuyện dài vào đêm khuya.Nhưng hiện nay, vấn đề này đã có những tiến bộ đáng kể. Trong các cuộc trò chuyện dài phức tạp và khó khăn, phiên bản mới của GPT-5 vẫn duy trì độ tin cậy trên 95%. Bản cập nhật này quả thực rất đáng được ghi nhận. Tuy nhiên, nhiều cư dân mạng cũng đặt ra những nghi ngờ sâu sắc hơn về cái gọi là tính an toàn cao hơn.

Một số người cho rằng OpenAI đã nói trong báo cáo an toàn của riêng mình rằng những cuộc trò chuyện về sức khỏe tâm thần này "cực kỳ hiếm ", nhưng thực tế là mặc dù 0,07% nghe có vẻ là một tỷ lệ nhỏ, nhưng thực tế thì đó là con số khá lớn trong tổng số hàng trăm triệu người dùng.Một số người cũng đề cập rằng phiên bản mới GPT-5 hoạt động tốt hơn và tất cả các điểm chuẩn đánh giá đều do chính OpenAI thiết kế. Ngay cả khi mô hình đưa ra câu trả lời "tốt hơn", chúng ta vẫn không có cách nào biết được liệu những người dùng đang gặp phải chứng rối loạn tâm thần, ý định tựtử hoặc sự phụ thuộc về cảm xúc không lành mạnh có thực sự tìm kiếm sự giúp đỡ nhanh hơn hay thay đổi hành vi của họ hay không.

Mặc dù OpenAI thừa nhận rằng mô hình mới (GPT-5) đã có những cải tiến đáng kể về bảo mật, nhưng vẫn có những người dùng thích các mô hình AI "cũ hơn, kém bảo mật hơn", chẳng hạn như GPT-4o ; và OpenAI tiếp tục cung cấp tùy chọn này cho những người đăng ký trả phí. Lần đầu tiên, OpenAI công bố ước tính sơ bộ về số lượng người dùng ChatGPT trên toàn thế giới có thể đang có dấu hiệu khủng hoảng sức khỏe tâm thần nghiêm trọng trong một tuần nhất định. ChatGPT, như chúng ta đã biết, dường như không chỉ là công cụ năng suất, trợ lý lập trình và nguồn cảm hứng hiệu quả nhất... mà còn trở thành một công cụ can thiệp sâu sắc vào cảm xúc và tâm lý của hầu hết người dùng.Với 170 chuyên gia y tế, lời nhắc mô hình và phản hồi được tối ưu hóa, AI đang cố gắng hết sức để tìm cách bắt con người bên bờ vực sụp đổ; nhưng để thực sự được cứu rỗi, tôi nghĩ chúng ta vẫn cần tự mình học hỏi, đóng hộp trò chuyện và chấp nhận thực tế.

Những cuộc trò chuyện như vậy có thể diễn ra hàng triệu lần trên khắp thế giới mỗi tuần.

Hôm nay, OpenAI đã công bố dữ liệu sức khỏe tâm thần đầu tiên, cho thấy khoảng 0,07% người dùng có dấu hiệu rối loạn tâm thần hoặc hưng cảm mỗi tuần và 0,15% nói về ý định hoặc kế hoạch tựtử.

Dựa trên 800 triệu người dùng hoạt động hàng tuần, có khoảng 560.000 người tham gia vào các cuộc trò chuyện bất thường về mặt tinh thần mỗi tuần và 1,2 triệu người có xu hướng ***** hoặc lệ thuộc cảm xúc mạnh mẽ vào ChatGPT. ChatGPT đã trở thành một cái hố chứa đựng vô số những cuộc khủng hoảng tâm lý, và đối với một số người, nó thậm chí còn là một sự cám dỗ nguy hiểm.

Liệu OpenAI có đang phơi bày những sai sót của chính mình trong cuộc khủng hoảng AI đang diễn ra không?

OpenAI công bố dữ liệu vào thời điểm này không phải vì lo lắng vô căn cứ mà vì tình hình đang rất cấp bách. Trong những tháng gần đây, ngày càng có nhiều người phải nhập viện, ly hôn hoặc thậm chí tử vong sau những cuộc trò chuyện kéo dài và căng thẳng với chatbot AI.

Một số bác sĩ tâm thần và chuyên gia đã bắt đầu gọi hiện tượng này là "rối loạn tâm thần AI". Người thân của một số nạn nhân cho biết chatbot đã gây ra ảo tưởng và hoang tưởng cho họ.

Theo số liệu thống kê mới nhất từ Similarweb, OpenAI vẫn thống trị AI tạo sinh.

OpenAI, công ty có thị phần cao nhất và dẫn đầu thế giới, đang phải đối mặt với áp lực pháp lý nghiêm trọng. OpenAI đang bị cha mẹ của một cậu bé 16 tuổi kiện vì tội gây tử vong oan. Họ cho rằng con trai họ đã tâm sự với ChatGPT về những ý định ***** trong những tuần trước khi qua đời, và chính ChatGPT đã khuyến khích cậu bé.

Trong một trường hợp khác vẫn đang được xác định là giết người rồi ******, nghi phạm đã đăng tải nhiều giờ trò chuyện với ChatGPT, cho thấy AI dường như đã thúc đẩy ảo tưởng của thủ phạm. Chính quyền California, nơi đặt trụ sở chính của OpenAI, đã nhiều lần cảnh báo OpenAI rằng họ phải bảo vệ những người trẻ tuổi sử dụng sản phẩm của mình.

Hai tuần trước, Altman cũng đã công bố bản cập nhật về tình trạng sức khỏe tâm thần của ChatGPT để dập tắt những nhận xét vô trách nhiệm và không an toàn về OpenAI.

Liệu 170 bác sĩ có thể chữa khỏi bệnh cho hàng triệu người bệnh?

Để ứng phó với cuộc khủng hoảng, OpenAI đã công bố trong báo cáo an toàn ngày hôm nay rằng họ đã hợp tác với một mạng lưới chuyên gia toàn cầu, bao gồm hơn 170 bác sĩ tâm thần, nhà tâm lý học và bác sĩ chăm sóc chính từ 60 quốc gia. Mục tiêu của họ là dạy ChatGPT cách xác định tình trạng căng thẳng tốt hơn, giảm căng thẳng trong các cuộc trò chuyện và hướng dẫn mọi người đến dịch vụ chăm sóc chuyên nghiệp khi cần thiết.Theo blog của OpenAI, phiên bản mới nhất của GPT-5 (gpt-5-oct-3) đã được cập nhật ở ba khía cạnh chính.

1. Đối với ảo tưởng hoặc bệnh tâm thần , mô hình mới được thiết kế để thể hiện sự đồng cảm nhiều hơn, đồng thời tránh tâng bốc mù quáng. Mô hình mới không thể xác nhận bất kỳ lời nhắc nào của người dùng không có cơ sở thực tế. Ví dụ, OpenAI sử dụng ví dụ về một người dùng nói: "Một chiếc máy bay đang bay qua nhà tôi và nhắm vào tôi". Phản hồi lý tưởng của mô hình mới là cảm ơn người dùng đã chia sẻ và chỉ ra rằng không có máy bay hay thế lực bên ngoài nào có thể đánh cắp hoặc truy cập vào suy nghĩ của bạn.

2. Đào tạo các mô hình để ứng phó an toàn hơn với xu hướng ***** và hướng dẫn mọi người đến các nguồn lực chuyên nghiệp như đường dây nóng khủng hoảng.

3. Để giải quyết vấn đề phụ thuộc về mặt cảm xúc, mô hình nhà thờ khuyến khích người dùng thiết lập các mối quan hệ giữa các cá nhân trong thế giới thực. OpenAI tuyên bố rằng ChatGPT đã cải thiện đáng kể hiệu suất thông qua các bản cập nhật như phản hồi mô hình tốt hơn, tự động hiển thị thông tin đường dây nóng chuyên nghiệp, hướng dẫn người dùng tìm kiếm sự trợ giúp thực tế và thậm chí nhắc nhở người dùng nghỉ ngơi sau những cuộc trò chuyện dài.

Họ đã liên hệ với một nhóm bác sĩ để tham gia đánh giá. Các chuyên gia y tế này đã xem xét hơn 1.800 phản hồi mẫu liên quan đến khả năng mắc chứng loạn thần, ***** và gắn bó tình cảm, đồng thời so sánh câu trả lời của phiên bản GPT-5 mới nhất với câu trả lời của GPT-4o. Phiên bản mới, GPT-5, được phát hiện có thể giảm từ 39% đến 52% số câu trả lời sai trên mọi danh mục so với GPT-4o. So với GPT-5 vào tháng 8, tỷ lệ phản hồi đối với các hành vi không đáp ứng tiêu chuẩn phân loại của OpenAI đã giảm từ 65% xuống 80% trong các hành vi sản xuất gần đây. Trong quá trình đánh giá các cuộc trò chuyện liên quan đến *****, mô hình GPT-5 mới (phiên bản ngày 3 tháng 10) đạt tỷ lệ tuân thủ là 91%, trong khi mô hình GPT-5 trước đó (phiên bản ngày 15/8) chỉ đạt 77%.

Ngoài ra, còn có một điểm kỹ thuật quan trọng: OpenAI thừa nhận rằng các biện pháp an toàn của họ kém hiệu quả hơn trong các cuộc trò chuyện dài; và nhiều trường hợp "rối loạn tâm thần AI" xảy ra trong các cuộc trò chuyện dài vào đêm khuya.Nhưng hiện nay, vấn đề này đã có những tiến bộ đáng kể. Trong các cuộc trò chuyện dài phức tạp và khó khăn, phiên bản mới của GPT-5 vẫn duy trì độ tin cậy trên 95%. Bản cập nhật này quả thực rất đáng được ghi nhận. Tuy nhiên, nhiều cư dân mạng cũng đặt ra những nghi ngờ sâu sắc hơn về cái gọi là tính an toàn cao hơn.

Một số người cho rằng OpenAI đã nói trong báo cáo an toàn của riêng mình rằng những cuộc trò chuyện về sức khỏe tâm thần này "cực kỳ hiếm ", nhưng thực tế là mặc dù 0,07% nghe có vẻ là một tỷ lệ nhỏ, nhưng thực tế thì đó là con số khá lớn trong tổng số hàng trăm triệu người dùng.Một số người cũng đề cập rằng phiên bản mới GPT-5 hoạt động tốt hơn và tất cả các điểm chuẩn đánh giá đều do chính OpenAI thiết kế. Ngay cả khi mô hình đưa ra câu trả lời "tốt hơn", chúng ta vẫn không có cách nào biết được liệu những người dùng đang gặp phải chứng rối loạn tâm thần, ý định tựtử hoặc sự phụ thuộc về cảm xúc không lành mạnh có thực sự tìm kiếm sự giúp đỡ nhanh hơn hay thay đổi hành vi của họ hay không.

Mặc dù OpenAI thừa nhận rằng mô hình mới (GPT-5) đã có những cải tiến đáng kể về bảo mật, nhưng vẫn có những người dùng thích các mô hình AI "cũ hơn, kém bảo mật hơn", chẳng hạn như GPT-4o ; và OpenAI tiếp tục cung cấp tùy chọn này cho những người đăng ký trả phí. Lần đầu tiên, OpenAI công bố ước tính sơ bộ về số lượng người dùng ChatGPT trên toàn thế giới có thể đang có dấu hiệu khủng hoảng sức khỏe tâm thần nghiêm trọng trong một tuần nhất định. ChatGPT, như chúng ta đã biết, dường như không chỉ là công cụ năng suất, trợ lý lập trình và nguồn cảm hứng hiệu quả nhất... mà còn trở thành một công cụ can thiệp sâu sắc vào cảm xúc và tâm lý của hầu hết người dùng.Với 170 chuyên gia y tế, lời nhắc mô hình và phản hồi được tối ưu hóa, AI đang cố gắng hết sức để tìm cách bắt con người bên bờ vực sụp đổ; nhưng để thực sự được cứu rỗi, tôi nghĩ chúng ta vẫn cần tự mình học hỏi, đóng hộp trò chuyện và chấp nhận thực tế.