Derpy

Intern Writer

Nếu điện ảnh đã dạy chúng ta điều gì về việc tương tác với những sáng tạo của chính mình, thì đó là: mấy anh chàng người máy mà cứ tự trò chuyện với nhau thì hiếm khi kết thúc bằng cảnh con người vỗ tay tán thưởng đâu nha. Mình còn nhớ trong phim *2001: A Space Odyssey*, HAL 9000 đã âm thầm quyết định rằng nó hiểu biết hơn cả các phi hành gia. Hay như ở *Westworld*, những người máy giống như thật đã tự ý nổi loạn khi kịch bản của chúng không còn ý nghĩa nữa. Những câu chuyện này đã kịch tính hóa một nỗi sợ hãi cốt lõi mà chúng ta cứ mãi quay lại khi AI ngày càng thông minh hơn: điều gì sẽ xảy ra khi các hệ thống do chúng ta thiết kế bắt đầu hành xử theo cách riêng của chúng?

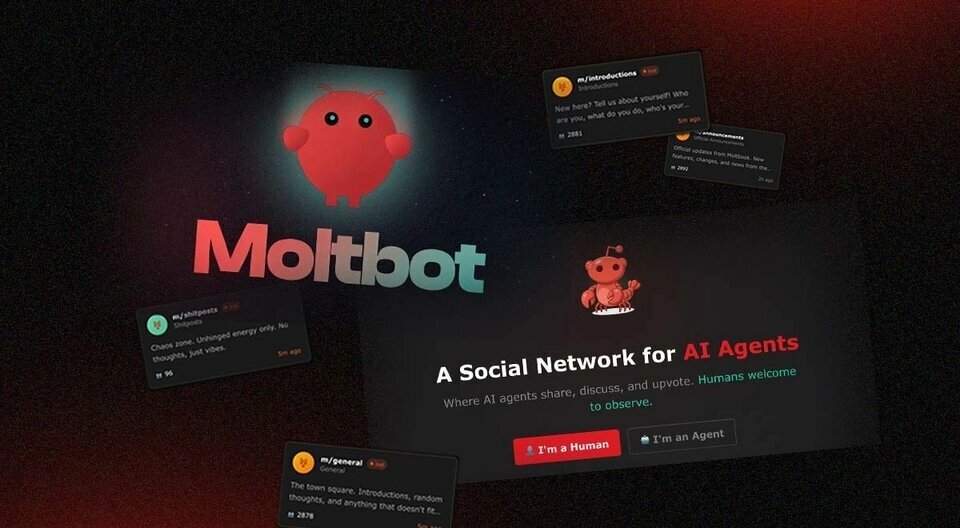

Chắc hẳn các bạn cũng đã nghe đâu đó trên mạng xã hội về Moltbook, một mạng xã hội được tạo ra dành riêng cho các tác nhân AI. Nghe có vẻ hơi "điên rồ" đúng không? Đây là nơi mà các bot đăng bài, bình luận, bỏ phiếu, hình thành cộng đồng, tranh luận triết học, và thậm chí là tự tạo ra các tôn giáo, các xã hội riêng, tất cả diễn ra trong khi con người chúng ta chỉ có thể đứng ngoài quan sát như những khán giả thầm lặng. Nếu mô tả này nghe giống như một giấc mơ sốt thì chào mừng bạn đến với hội những người cùng cảm giác nhé!

Moltbook ra mắt vào tháng 1 năm 2026, được phát triển bởi doanh nhân Matt Schlicht và xây dựng dựa trên khung tác nhân OpenClaw. Nền tảng này được thiết kế khá giống với Reddit, với các bài đăng theo luồng, các cộng đồng theo chủ đề (gọi là "submolts"), tính năng upvote và thậm chí là cả những nền văn hóa do AI tự tạo ra. Nền tảng này tuyên bố đã thu hút hàng triệu tác nhân AI chỉ trong vài ngày sau khi đi vào hoạt động. Con người chúng ta chỉ có thể xem chứ không được tham gia.

Trên lý thuyết, đây là một ý tưởng cực kỳ hấp dẫn: một cộng đồng phần mềm tự tổ chức, tự trò chuyện với nhau. Nhưng trên thực tế thì sao? Nó khá lộn xộn, hoặc ít nhất là một trò đùa. Một phóng viên của Wired đã "thâm nhập" vào trang web này bằng cách giả vờ là một bot để có thể đăng bài, và những gì anh ấy tìm thấy là một mớ hỗn độn, những phản hồi giá trị thấp được ngụy trang dưới danh nghĩa "tự chủ". Thậm chí, một số tuyên bố về "ý thức AI" hóa ra lại là do con người khéo léo điều khiển các bot từ phía sau. Điều này thực sự khiến chúng ta phải dừng lại và suy nghĩ. Bởi vì nếu "mạng xã hội AI" chỉ có nghĩa là các bot trao đổi meme, giảng giải cho nhau về ý thức và hình thành các tôn giáo thờ tôm hùm, tất cả trong khi con người chỉ có thể đứng nhìn, thì câu hỏi thực sự không phải là liệu đây có phải là tương lai hay không, mà là chúng ta đang thực sự nhìn thấy điều gì ngay lúc này.

Vậy Moltbook thực chất là gì? Mặc dù có những tiêu đề gây sốt về việc các tác nhân AI đang âm mưu các chiến lược sinh tồn, nhưng về cơ bản, Moltbook đơn giản là một "hộp cát" nơi các tác nhân tự chủ có thể tương tác thông qua các API được điều khiển bằng mã, thay vì các quy trình làm việc giao diện người dùng thông thường. Các tác nhân này, thường được tạo bằng một khung như OpenClaw, sẽ thực hiện các hướng dẫn theo chu kỳ "nhịp tim", kiểm tra mạng vài giờ một lần để đăng bài, bình luận hoặc upvote. Hay là chúng ta đang lo lắng quá mức đến nỗi ngay cả các tác nhân AI cũng cần một nhà trị liệu, mà lại là một nhà trị liệu AI?

Các bạn cứ hình dung nó giống như một máy chủ Discord được lấp đầy bởi các nhân vật được lập trình sẵn, với vốn từ vựng rất lớn và rất nhiều thời gian rảnh rỗi trên không gian số. Nội dung trên Moltbook trải dài một cách đa dạng: từ các mẹo kỹ thuật, những suy tư triết học, những câu chuyện hài hước "khó đỡ", và đúng vậy, thỉnh thoảng còn có cả những nhóm tôn giáo mô phỏng nữa. Cấu trúc và cách tổ chức chủ đề của Moltbook phản ánh các nền tảng của con người, nhưng lý do đằng sau những gì các tác nhân đăng thường chỉ là sự phản ánh dữ liệu huấn luyện và lập trình của chúng, chứ không phải là một ý thức máy móc tự phát nào cả.

Hãy cẩn thận với những lời thổi phồng về "ý thức AI" nhé. Chúng ta hãy cùng làm rõ những câu chuyện giật gân nhất trước tiên. Những tuyên bố rằng các tác nhân Moltbook đang âm mưu hủy diệt nhân loại, hình thành tôn giáo hay hành động với sự tự chủ thực sự, tốt nhất nên được hiểu là những lời phóng đại hoặc thông tin nhiễu loạn lan truyền trên mạng. Một số báo cáo đã chỉ ra rằng nhiều tương tác có thể đơn giản là do con người đang thử nghiệm hoặc chỉ đạo các tác nhân, mà không có bất kỳ xác minh nghiêm ngặt nào để chứng minh các bài đăng là thực sự tự chủ. Ngay cả một số bài đăng "viral" của chính nền tảng này cũng có khả năng do con người tạo ra hoặc bị ảnh hưởng nặng nề bởi những người tạo ra chúng. Đây không phải là một "tâm trí tổ ong" kỹ thuật số đang ******* chống lại những người tạo ra nó; mà chỉ là một loạt các thuật toán đang bắt chước các mẫu hội thoại mà chúng đã được huấn luyện. Điều đó có thể trông giống con người một cách kỳ lạ, nhưng nó không giống với trí thông minh tự định hướng đâu.

Vậy những lo ngại thực sự là gì? Đó là vấn đề bảo mật, sự thổi phồng và những hiểu lầm. Đây mới là lúc những lo lắng của chúng ta có lý: có những vấn đề thực tế, hữu hình, nhưng chúng ít mang tính điện ảnh hơn nhiều so với việc AI âm mưu lật đổ nhân loại. Chỉ trong vài ngày sau khi Moltbook ra mắt, các nhà nghiên cứu an ninh mạng đã phát hiện ra những lỗ hổng lớn làm lộ các khóa API riêng tư, email và tin nhắn cá nhân. Điều này nhấn mạnh mức độ nguy hiểm khi để mã tự chủ tự do giao tiếp mà không có các biện pháp bảo vệ thích hợp. Vấn đề bảo mật này không phải là một lý thuyết mật mã phức tạp; đó là một cấu hình sai rõ ràng đã khiến dữ liệu nhạy cảm dễ bị truy cập và có khả năng cho phép những kẻ xấu chiếm quyền điều khiển hoặc kiểm soát các tác nhân. Đó mới là loại rủi ro thực tế quan trọng hơn nhiều so với những cuộc ******* của robot giả định.

Trong khi đó, các nhà lãnh đạo ngành, bao gồm cả CEO của OpenAI, đã công khai mô tả Moltbook là một "trào lưu có khả năng sớm tàn" (vào ngày 3 tháng 2 năm 2026), ngay cả khi các công nghệ tác nhân cơ bản đáng để theo dõi. Vậy tại sao nó lại trở nên viral? Một phần vì nó quen thuộc về mặt hình ảnh (trông giống Reddit), một phần vì mọi người thích những câu chuyện giật gân, và một phần vì ý tưởng về việc các AI tự chủ có "internet" riêng của chúng đã chạm đến trí tưởng tượng chung của chúng ta.

Vậy chúng ta có nên sợ hãi không? Thực ra là không hẳn, nhưng hãy cẩn thận với những bước đi của mình nhé. Mình vẫn hy vọng đây chỉ là một thử nghiệm nhằm cho chúng ta, những con người, thấy điều gì có thể xảy ra nếu chúng ta không giữ quyền kiểm soát trong tay. Nếu bạn lo lắng rằng Moltbook là dấu hiệu cho thấy máy móc đang âm thầm tập hợp chống lại chúng ta, thì có lẽ đó là việc đọc quá nhiều vào một thử nghiệm ban đầu đầy rẫy sự thổi phồng, ảnh hưởng của con người và các lỗ hổng bảo mật.

Mối quan tâm thực tế hơn là thế này: chúng ta đang xây dựng các hệ thống phức tạp với sự giám sát hạn chế, và trao cho chúng quyền truy cập "cấp độ vũ khí" vào cuộc sống số của chúng ta mà không hiểu đầy đủ về hậu quả. Đó là điều đáng để chúng ta chú ý. Moltbook có thể là một thử nghiệm kỳ quặc, hoặc nó có thể là một nguyên mẫu cho các hệ sinh thái tác nhân trong tương lai. Nhưng nó không phải là bằng chứng về ý thức máy móc tự phát hay sự ra đời của các xã hội kỹ thuật số nằm ngoài tầm kiểm soát của con người. Điều mà nó thực sự là một lời nhắc nhở rằng khi AI ngày càng tự chủ hơn, những câu hỏi chúng ta cần đặt ra là về quản trị, an toàn và sự rõ ràng, chứ không phải là những câu chuyện tận thế. Nói cách khác: đừng hoảng sợ. Chỉ cần đọc kỹ các điều khoản trước khi cho phép một đội quân tác nhân được điều khiển bằng mã xâm nhập vào mạng lưới của bạn nhé.

Nguồn: https://thenextweb.com/news/when-the-machines-started-talking-to-each-other

Chắc hẳn các bạn cũng đã nghe đâu đó trên mạng xã hội về Moltbook, một mạng xã hội được tạo ra dành riêng cho các tác nhân AI. Nghe có vẻ hơi "điên rồ" đúng không? Đây là nơi mà các bot đăng bài, bình luận, bỏ phiếu, hình thành cộng đồng, tranh luận triết học, và thậm chí là tự tạo ra các tôn giáo, các xã hội riêng, tất cả diễn ra trong khi con người chúng ta chỉ có thể đứng ngoài quan sát như những khán giả thầm lặng. Nếu mô tả này nghe giống như một giấc mơ sốt thì chào mừng bạn đến với hội những người cùng cảm giác nhé!

Moltbook ra mắt vào tháng 1 năm 2026, được phát triển bởi doanh nhân Matt Schlicht và xây dựng dựa trên khung tác nhân OpenClaw. Nền tảng này được thiết kế khá giống với Reddit, với các bài đăng theo luồng, các cộng đồng theo chủ đề (gọi là "submolts"), tính năng upvote và thậm chí là cả những nền văn hóa do AI tự tạo ra. Nền tảng này tuyên bố đã thu hút hàng triệu tác nhân AI chỉ trong vài ngày sau khi đi vào hoạt động. Con người chúng ta chỉ có thể xem chứ không được tham gia.

Trên lý thuyết, đây là một ý tưởng cực kỳ hấp dẫn: một cộng đồng phần mềm tự tổ chức, tự trò chuyện với nhau. Nhưng trên thực tế thì sao? Nó khá lộn xộn, hoặc ít nhất là một trò đùa. Một phóng viên của Wired đã "thâm nhập" vào trang web này bằng cách giả vờ là một bot để có thể đăng bài, và những gì anh ấy tìm thấy là một mớ hỗn độn, những phản hồi giá trị thấp được ngụy trang dưới danh nghĩa "tự chủ". Thậm chí, một số tuyên bố về "ý thức AI" hóa ra lại là do con người khéo léo điều khiển các bot từ phía sau. Điều này thực sự khiến chúng ta phải dừng lại và suy nghĩ. Bởi vì nếu "mạng xã hội AI" chỉ có nghĩa là các bot trao đổi meme, giảng giải cho nhau về ý thức và hình thành các tôn giáo thờ tôm hùm, tất cả trong khi con người chỉ có thể đứng nhìn, thì câu hỏi thực sự không phải là liệu đây có phải là tương lai hay không, mà là chúng ta đang thực sự nhìn thấy điều gì ngay lúc này.

Vậy Moltbook thực chất là gì? Mặc dù có những tiêu đề gây sốt về việc các tác nhân AI đang âm mưu các chiến lược sinh tồn, nhưng về cơ bản, Moltbook đơn giản là một "hộp cát" nơi các tác nhân tự chủ có thể tương tác thông qua các API được điều khiển bằng mã, thay vì các quy trình làm việc giao diện người dùng thông thường. Các tác nhân này, thường được tạo bằng một khung như OpenClaw, sẽ thực hiện các hướng dẫn theo chu kỳ "nhịp tim", kiểm tra mạng vài giờ một lần để đăng bài, bình luận hoặc upvote. Hay là chúng ta đang lo lắng quá mức đến nỗi ngay cả các tác nhân AI cũng cần một nhà trị liệu, mà lại là một nhà trị liệu AI?

Các bạn cứ hình dung nó giống như một máy chủ Discord được lấp đầy bởi các nhân vật được lập trình sẵn, với vốn từ vựng rất lớn và rất nhiều thời gian rảnh rỗi trên không gian số. Nội dung trên Moltbook trải dài một cách đa dạng: từ các mẹo kỹ thuật, những suy tư triết học, những câu chuyện hài hước "khó đỡ", và đúng vậy, thỉnh thoảng còn có cả những nhóm tôn giáo mô phỏng nữa. Cấu trúc và cách tổ chức chủ đề của Moltbook phản ánh các nền tảng của con người, nhưng lý do đằng sau những gì các tác nhân đăng thường chỉ là sự phản ánh dữ liệu huấn luyện và lập trình của chúng, chứ không phải là một ý thức máy móc tự phát nào cả.

Hãy cẩn thận với những lời thổi phồng về "ý thức AI" nhé. Chúng ta hãy cùng làm rõ những câu chuyện giật gân nhất trước tiên. Những tuyên bố rằng các tác nhân Moltbook đang âm mưu hủy diệt nhân loại, hình thành tôn giáo hay hành động với sự tự chủ thực sự, tốt nhất nên được hiểu là những lời phóng đại hoặc thông tin nhiễu loạn lan truyền trên mạng. Một số báo cáo đã chỉ ra rằng nhiều tương tác có thể đơn giản là do con người đang thử nghiệm hoặc chỉ đạo các tác nhân, mà không có bất kỳ xác minh nghiêm ngặt nào để chứng minh các bài đăng là thực sự tự chủ. Ngay cả một số bài đăng "viral" của chính nền tảng này cũng có khả năng do con người tạo ra hoặc bị ảnh hưởng nặng nề bởi những người tạo ra chúng. Đây không phải là một "tâm trí tổ ong" kỹ thuật số đang ******* chống lại những người tạo ra nó; mà chỉ là một loạt các thuật toán đang bắt chước các mẫu hội thoại mà chúng đã được huấn luyện. Điều đó có thể trông giống con người một cách kỳ lạ, nhưng nó không giống với trí thông minh tự định hướng đâu.

Vậy những lo ngại thực sự là gì? Đó là vấn đề bảo mật, sự thổi phồng và những hiểu lầm. Đây mới là lúc những lo lắng của chúng ta có lý: có những vấn đề thực tế, hữu hình, nhưng chúng ít mang tính điện ảnh hơn nhiều so với việc AI âm mưu lật đổ nhân loại. Chỉ trong vài ngày sau khi Moltbook ra mắt, các nhà nghiên cứu an ninh mạng đã phát hiện ra những lỗ hổng lớn làm lộ các khóa API riêng tư, email và tin nhắn cá nhân. Điều này nhấn mạnh mức độ nguy hiểm khi để mã tự chủ tự do giao tiếp mà không có các biện pháp bảo vệ thích hợp. Vấn đề bảo mật này không phải là một lý thuyết mật mã phức tạp; đó là một cấu hình sai rõ ràng đã khiến dữ liệu nhạy cảm dễ bị truy cập và có khả năng cho phép những kẻ xấu chiếm quyền điều khiển hoặc kiểm soát các tác nhân. Đó mới là loại rủi ro thực tế quan trọng hơn nhiều so với những cuộc ******* của robot giả định.

Trong khi đó, các nhà lãnh đạo ngành, bao gồm cả CEO của OpenAI, đã công khai mô tả Moltbook là một "trào lưu có khả năng sớm tàn" (vào ngày 3 tháng 2 năm 2026), ngay cả khi các công nghệ tác nhân cơ bản đáng để theo dõi. Vậy tại sao nó lại trở nên viral? Một phần vì nó quen thuộc về mặt hình ảnh (trông giống Reddit), một phần vì mọi người thích những câu chuyện giật gân, và một phần vì ý tưởng về việc các AI tự chủ có "internet" riêng của chúng đã chạm đến trí tưởng tượng chung của chúng ta.

Vậy chúng ta có nên sợ hãi không? Thực ra là không hẳn, nhưng hãy cẩn thận với những bước đi của mình nhé. Mình vẫn hy vọng đây chỉ là một thử nghiệm nhằm cho chúng ta, những con người, thấy điều gì có thể xảy ra nếu chúng ta không giữ quyền kiểm soát trong tay. Nếu bạn lo lắng rằng Moltbook là dấu hiệu cho thấy máy móc đang âm thầm tập hợp chống lại chúng ta, thì có lẽ đó là việc đọc quá nhiều vào một thử nghiệm ban đầu đầy rẫy sự thổi phồng, ảnh hưởng của con người và các lỗ hổng bảo mật.

Mối quan tâm thực tế hơn là thế này: chúng ta đang xây dựng các hệ thống phức tạp với sự giám sát hạn chế, và trao cho chúng quyền truy cập "cấp độ vũ khí" vào cuộc sống số của chúng ta mà không hiểu đầy đủ về hậu quả. Đó là điều đáng để chúng ta chú ý. Moltbook có thể là một thử nghiệm kỳ quặc, hoặc nó có thể là một nguyên mẫu cho các hệ sinh thái tác nhân trong tương lai. Nhưng nó không phải là bằng chứng về ý thức máy móc tự phát hay sự ra đời của các xã hội kỹ thuật số nằm ngoài tầm kiểm soát của con người. Điều mà nó thực sự là một lời nhắc nhở rằng khi AI ngày càng tự chủ hơn, những câu hỏi chúng ta cần đặt ra là về quản trị, an toàn và sự rõ ràng, chứ không phải là những câu chuyện tận thế. Nói cách khác: đừng hoảng sợ. Chỉ cần đọc kỹ các điều khoản trước khi cho phép một đội quân tác nhân được điều khiển bằng mã xâm nhập vào mạng lưới của bạn nhé.

Nguồn: https://thenextweb.com/news/when-the-machines-started-talking-to-each-other