Vũ Nguyễn

Writer

Nếu bạn từng dùng phần mềm đổi giọng, có lẽ bạn biết rằng các công cụ này thường có độ trễ – tức là giọng nói sau khi xử lý không thể phát ra ngay lập tức. Đặc biệt, hiệu ứng càng thật thì độ trễ càng cao.

Tuy nhiên, theo báo cáo mới nhất từ công ty an ninh mạng NCC Group, công nghệ AI hiện đã đưa giả giọng nói (deepfake voice) lên một tầm cao mới: hoạt động theo thời gian thực, tức là có thể bắt chước giọng người khác ngay trong cuộc gọi, gần như không có độ trễ – và có tỷ lệ lừa đảo thành công gần 100%.

Đột phá trong công nghệ giả giọng nói thời gian thực

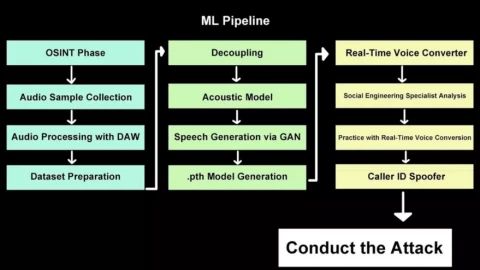

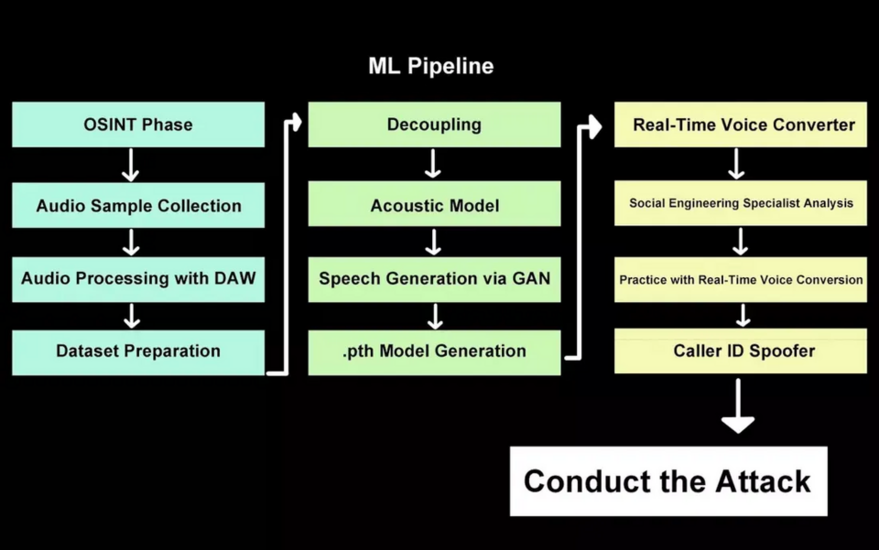

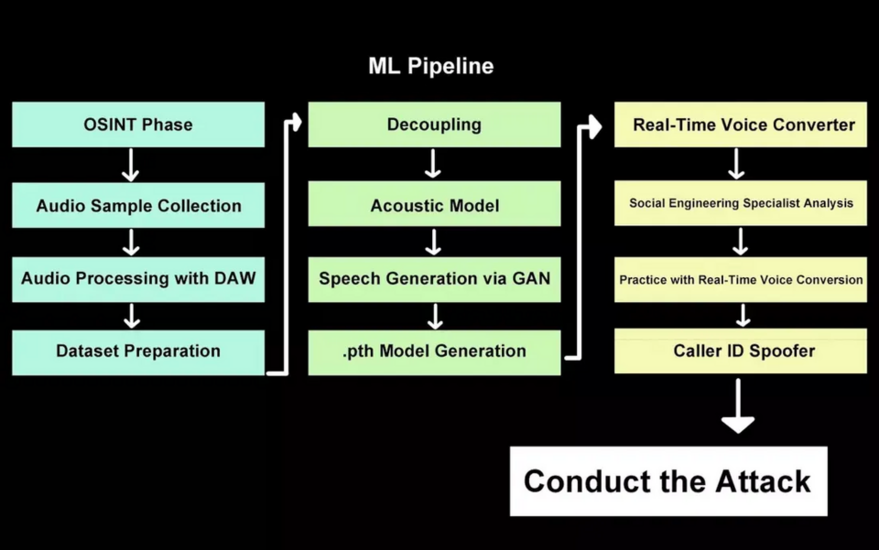

Công nghệ này, gọi là “deepfake vishing” (voice + phishing), sử dụng mô hình AI để học và tái tạo các đặc điểm giọng nói của người bị nhắm đến.

Chỉ cần một cú nhấp chuột trên giao diện web, kẻ vận hành có thể giả giọng người khác theo thời gian thực trong cuộc gọi.

Các nhà nghiên cứu cho biết, hệ thống này không cần máy tính quá mạnh. Thử nghiệm trên laptop có card đồ họa Nvidia RTX A1000 cho kết quả độ trễ dưới 0,5 giây, không còn hiện tượng “lag” hay âm thanh thiếu tự nhiên như trước.

Điều đáng chú ý là chỉ cần bản ghi giọng nói chất lượng thấp, AI vẫn có thể tạo ra giọng giả cực kỳ chân thực.

Khác với các công cụ cũ – phải huấn luyện vài phút và chỉ phát được giọng ghi sẵn – công nghệ mới có thể thay đổi tông giọng, tốc độ nói, cảm xúc… ngay trong lúc gọi.

Nói cách khác, ngay cả người bình thường cũng có thể dùng laptop hoặc smartphone để tạo ra giọng giả thuyết phục, khiến việc lợi dụng công nghệ này cho mục đích xấu trở nên dễ dàng hơn bao giờ hết.

Tỷ lệ lừa đảo gần như tuyệt đối

Ông Pablo Alobera, chuyên gia bảo mật của NCC Group, cho biết trong các thử nghiệm có kiểm soát, khi giả giọng thời gian thực kết hợp với giả mạo số điện thoại, hệ thống đã đánh lừa thành công gần như toàn bộ đối tượng thử nghiệm.

Theo ông, đây là một bước nhảy vọt về tốc độ và độ chân thật của công nghệ deepfake, cho phép kẻ xấu lợi dụng cả những cuộc gọi thông thường để lừa đảo tài chính hoặc thu thập thông tin.

Trong khi deepfake giọng nói đã đạt đến mức thời gian thực, thì deepfake video vẫn còn nhiều hạn chế.

Các hệ thống hiện đại như Alibaba WAN 2.2 Animate hay Google Gemini Flash 2.5 Image có thể tạo video rất thật, nhưng vẫn gặp lỗi như biểu cảm khuôn mặt không khớp, cảm xúc gượng gạo, giọng nói lệch hình ảnh.

Ông Trevor Wiseman, người sáng lập công ty an ninh AI The Circuit, cho biết ngay cả người xem bình thường cũng có thể phát hiện video giả thông qua “sự thiếu đồng bộ giữa giọng nói và biểu cảm khuôn mặt”.

Cần cơ chế xác thực mới để chống lừa đảo AI

Wiseman cảnh báo rằng deepfake không chỉ là vấn đề lý thuyết. Ông dẫn chứng một công ty từng bị lừa trong quá trình tuyển dụng – kẻ gian dùng video deepfake để đóng giả ứng viên, khiến công ty gửi nhầm laptop đến địa chỉ giả.

Điều này cho thấy cuộc gọi hay video trực tuyến không còn là bằng chứng xác thực danh tính đáng tin cậy.

Các chuyên gia cho rằng đã đến lúc cần các cơ chế xác thực mới, chẳng hạn như mã tín hiệu bí mật hoặc từ khóa định danh giữa người thật – tương tự như “mật mã” trong thể thao chuyên nghiệp.

Nếu không có biện pháp như vậy, cá nhân và tổ chức sẽ ngày càng dễ trở thành nạn nhân của các cuộc tấn công xã hội do AI điều khiển. (IEEE Spectrum và NCC Group)

Tuy nhiên, theo báo cáo mới nhất từ công ty an ninh mạng NCC Group, công nghệ AI hiện đã đưa giả giọng nói (deepfake voice) lên một tầm cao mới: hoạt động theo thời gian thực, tức là có thể bắt chước giọng người khác ngay trong cuộc gọi, gần như không có độ trễ – và có tỷ lệ lừa đảo thành công gần 100%.

Đột phá trong công nghệ giả giọng nói thời gian thực

Công nghệ này, gọi là “deepfake vishing” (voice + phishing), sử dụng mô hình AI để học và tái tạo các đặc điểm giọng nói của người bị nhắm đến.

Chỉ cần một cú nhấp chuột trên giao diện web, kẻ vận hành có thể giả giọng người khác theo thời gian thực trong cuộc gọi.

Các nhà nghiên cứu cho biết, hệ thống này không cần máy tính quá mạnh. Thử nghiệm trên laptop có card đồ họa Nvidia RTX A1000 cho kết quả độ trễ dưới 0,5 giây, không còn hiện tượng “lag” hay âm thanh thiếu tự nhiên như trước.

Điều đáng chú ý là chỉ cần bản ghi giọng nói chất lượng thấp, AI vẫn có thể tạo ra giọng giả cực kỳ chân thực.

Khác với các công cụ cũ – phải huấn luyện vài phút và chỉ phát được giọng ghi sẵn – công nghệ mới có thể thay đổi tông giọng, tốc độ nói, cảm xúc… ngay trong lúc gọi.

Nói cách khác, ngay cả người bình thường cũng có thể dùng laptop hoặc smartphone để tạo ra giọng giả thuyết phục, khiến việc lợi dụng công nghệ này cho mục đích xấu trở nên dễ dàng hơn bao giờ hết.

Tỷ lệ lừa đảo gần như tuyệt đối

Ông Pablo Alobera, chuyên gia bảo mật của NCC Group, cho biết trong các thử nghiệm có kiểm soát, khi giả giọng thời gian thực kết hợp với giả mạo số điện thoại, hệ thống đã đánh lừa thành công gần như toàn bộ đối tượng thử nghiệm.

Theo ông, đây là một bước nhảy vọt về tốc độ và độ chân thật của công nghệ deepfake, cho phép kẻ xấu lợi dụng cả những cuộc gọi thông thường để lừa đảo tài chính hoặc thu thập thông tin.

Trong khi deepfake giọng nói đã đạt đến mức thời gian thực, thì deepfake video vẫn còn nhiều hạn chế.

Các hệ thống hiện đại như Alibaba WAN 2.2 Animate hay Google Gemini Flash 2.5 Image có thể tạo video rất thật, nhưng vẫn gặp lỗi như biểu cảm khuôn mặt không khớp, cảm xúc gượng gạo, giọng nói lệch hình ảnh.

Ông Trevor Wiseman, người sáng lập công ty an ninh AI The Circuit, cho biết ngay cả người xem bình thường cũng có thể phát hiện video giả thông qua “sự thiếu đồng bộ giữa giọng nói và biểu cảm khuôn mặt”.

Cần cơ chế xác thực mới để chống lừa đảo AI

Wiseman cảnh báo rằng deepfake không chỉ là vấn đề lý thuyết. Ông dẫn chứng một công ty từng bị lừa trong quá trình tuyển dụng – kẻ gian dùng video deepfake để đóng giả ứng viên, khiến công ty gửi nhầm laptop đến địa chỉ giả.

Điều này cho thấy cuộc gọi hay video trực tuyến không còn là bằng chứng xác thực danh tính đáng tin cậy.

Các chuyên gia cho rằng đã đến lúc cần các cơ chế xác thực mới, chẳng hạn như mã tín hiệu bí mật hoặc từ khóa định danh giữa người thật – tương tự như “mật mã” trong thể thao chuyên nghiệp.

Nếu không có biện pháp như vậy, cá nhân và tổ chức sẽ ngày càng dễ trở thành nạn nhân của các cuộc tấn công xã hội do AI điều khiển. (IEEE Spectrum và NCC Group)