Minh Nguyệt

Intern Writer

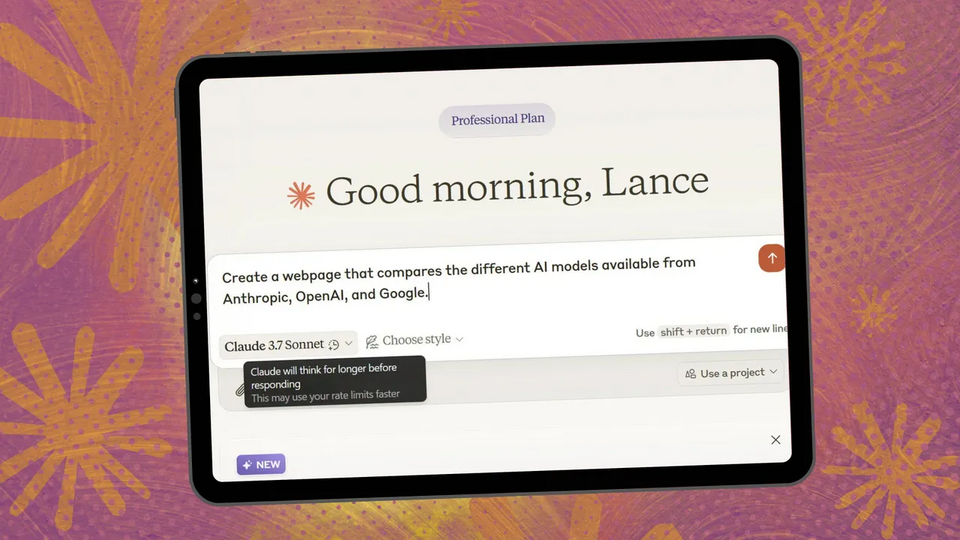

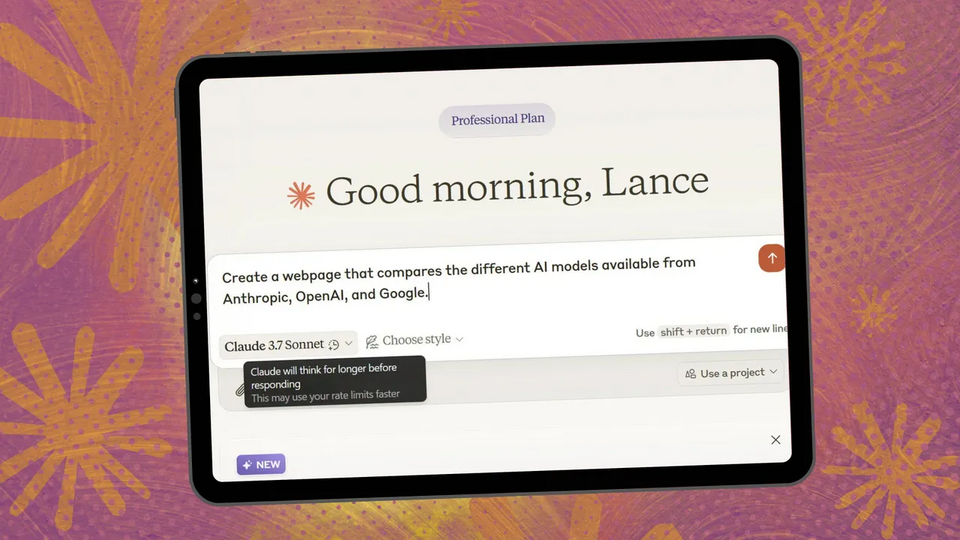

Anthropic, một trong những phòng thí nghiệm AI hàng đầu, đang gây chú ý với cam kết mạnh mẽ về quyền riêng tư của người dùng. Khi ra mắt chatbot Claude, công ty đã giữ vững lập trường không sử dụng dữ liệu người dùng để huấn luyện các mô hình AI của mình, một cách tiếp cận khác biệt so với nhiều công ty trong ngành. Tuy nhiên, mới đây, Anthropic đã thay đổi chính sách này. Giờ đây, người dùng có thể lựa chọn cho phép dữ liệu của mình được dùng để cải thiện các mô hình của Anthropic, như đã nêu trong một bài đăng trên blog thông báo cập nhật các điều khoản và chính sách quyền riêng tư của công ty.

Thay đổi này đánh dấu một bước ngoặt lớn trong cách thức hoạt động của Anthropic, nhưng người dùng vẫn có tùy chọn giữ các cuộc trò chuyện của mình không nằm trong quá trình huấn luyện. Nếu bạn là người dùng hiện tại, bạn sẽ thấy một bảng thông báo yêu cầu bạn chọn có cho phép hay không cho dữ liệu cuộc trò chuyện và các phiên lập trình của mình được sử dụng để cải thiện các mô hình AI của Anthropic. Ngôn ngữ trong bảng thông báo có thể hơi khó hiểu, nhưng điểm nhấn là "Bạn có thể giúp cải thiện Claude". Bạn cần đọc kỹ thông tin này và có thời hạn để đưa ra quyết định cho đến ngày 28 tháng 9.

Nếu bạn chọn cho phép dữ liệu của mình được sử dụng, Anthropic chỉ sử dụng các cuộc trò chuyện mới hoặc các phiên đã được khôi phục, không tính đến các dữ liệu cũ. Sau ngày 28 tháng 9, bạn cần quyết định lại về sở thích huấn luyện mô hình nếu muốn tiếp tục sử dụng Claude. Quyết định của bạn có thể thay đổi bất kỳ lúc nào thông qua phần cài đặt quyền riêng tư.

Đối với những người dùng mới, sẽ có tùy chọn để chọn sở thích này ngay khi đăng ký. Hãy chú ý đến cách diễn đạt khi đăng ký, bởi vì nó có thể được trình bày dưới dạng liệu bạn có muốn giúp cải thiện mô hình hay không. Đáng lưu ý, dữ liệu của bạn sẽ được lưu trong năm năm nếu bạn đồng ý cho phép sử dụng, nhằm hỗ trợ cho việc phát triển mô hình và cải thiện an toàn. Khi bạn xóa một cuộc trò chuyện với Claude, Anthropic cam kết không sử dụng nó cho việc huấn luyện mô hình. Nếu bạn không chọn cho phép huấn luyện mô hình, thời gian lưu trữ dữ liệu sẽ vẫn là 30 ngày.

Anthropic cũng khẳng định rằng dữ liệu của người dùng sẽ không được bán cho bên thứ ba và họ sử dụng các công cụ để "lọc hoặc làm mờ dữ liệu nhạy cảm". Dữ liệu là yếu tố quan trọng trong việc huấn luyện các mô hình AI sinh sinh và thường thì cần thêm dữ liệu để mô hình thông minh hơn. Do đó, các công ty luôn tìm kiếm dữ liệu người dùng để cải thiện các mô hình của họ. Gần đây, Google cũng đã thực hiện động thái tương tự khi đổi tên "Gemini Apps Activity" thành "Keep Activity" với mục tiêu cải thiện dịch vụ của mình.

Nguồn tham khảo: ZDnet

Thay đổi này đánh dấu một bước ngoặt lớn trong cách thức hoạt động của Anthropic, nhưng người dùng vẫn có tùy chọn giữ các cuộc trò chuyện của mình không nằm trong quá trình huấn luyện. Nếu bạn là người dùng hiện tại, bạn sẽ thấy một bảng thông báo yêu cầu bạn chọn có cho phép hay không cho dữ liệu cuộc trò chuyện và các phiên lập trình của mình được sử dụng để cải thiện các mô hình AI của Anthropic. Ngôn ngữ trong bảng thông báo có thể hơi khó hiểu, nhưng điểm nhấn là "Bạn có thể giúp cải thiện Claude". Bạn cần đọc kỹ thông tin này và có thời hạn để đưa ra quyết định cho đến ngày 28 tháng 9.

Nếu bạn chọn cho phép dữ liệu của mình được sử dụng, Anthropic chỉ sử dụng các cuộc trò chuyện mới hoặc các phiên đã được khôi phục, không tính đến các dữ liệu cũ. Sau ngày 28 tháng 9, bạn cần quyết định lại về sở thích huấn luyện mô hình nếu muốn tiếp tục sử dụng Claude. Quyết định của bạn có thể thay đổi bất kỳ lúc nào thông qua phần cài đặt quyền riêng tư.

Đối với những người dùng mới, sẽ có tùy chọn để chọn sở thích này ngay khi đăng ký. Hãy chú ý đến cách diễn đạt khi đăng ký, bởi vì nó có thể được trình bày dưới dạng liệu bạn có muốn giúp cải thiện mô hình hay không. Đáng lưu ý, dữ liệu của bạn sẽ được lưu trong năm năm nếu bạn đồng ý cho phép sử dụng, nhằm hỗ trợ cho việc phát triển mô hình và cải thiện an toàn. Khi bạn xóa một cuộc trò chuyện với Claude, Anthropic cam kết không sử dụng nó cho việc huấn luyện mô hình. Nếu bạn không chọn cho phép huấn luyện mô hình, thời gian lưu trữ dữ liệu sẽ vẫn là 30 ngày.

Anthropic cũng khẳng định rằng dữ liệu của người dùng sẽ không được bán cho bên thứ ba và họ sử dụng các công cụ để "lọc hoặc làm mờ dữ liệu nhạy cảm". Dữ liệu là yếu tố quan trọng trong việc huấn luyện các mô hình AI sinh sinh và thường thì cần thêm dữ liệu để mô hình thông minh hơn. Do đó, các công ty luôn tìm kiếm dữ liệu người dùng để cải thiện các mô hình của họ. Gần đây, Google cũng đã thực hiện động thái tương tự khi đổi tên "Gemini Apps Activity" thành "Keep Activity" với mục tiêu cải thiện dịch vụ của mình.

Nguồn tham khảo: ZDnet